AI换脸终结者问世!美国防部推首款AI侦测工具,“反换脸”精度99%!

编者按:本文来自微信公众号“新智元”(ID:AI_era),作者文强、大明、肖琴。36氪经授权转载。

美国防部研发出了全球首款“反AI变脸刑侦检测工具”,专用于检测AI变脸/换脸造假技术。如今,以GAN为代表的AI换脸术盛行,相应的人脸检测识别技术也不得不提升,这仅仅是一场漫长而又精彩的AI军备竞赛的开始。

昨天,新智元介绍南加州大学“杀马特教授”黎颢率领的Pinscreen团队的实时3D变脸技术后,引发了不少读者的担忧。

黎颢团队的实时变脸技术:左边是iPhone拍摄的图像,右边是实时生成的3D人脸。来源:fxguide.com

有人担心,支付宝的人脸识别技术会因此失效,或者衍生出新的诈骗方法,犯罪者利用你的图片冒充你跟另一个人聊天……

这些担忧都是切实存在的,因为如今的“AI变脸术”,已经达到出神入化的境界,任何人利用AI软件,几乎都能做到模仿政治人物的脸,要是有一定技术的人,还能做到真假难辨的程度:

这些AI变脸工具,实际上都源自于生成对抗网络(GAN)强大的图像生成能力。

不过,现在美国国防部研究机构 DAPRA 研发出了首款“反变脸”的AI刑侦检测工具,而其原理,也是以AI攻AI。

这款AI反变脸刑侦工具是DARPA Media Forensics 计划的一部分。早在今年 5 月,DARPA 便提出了要研发针对AI变脸技术的需求,让现有的刑侦检测工具变得自动化,能够检测近来涌现的AI假脸。

DARPA Media Forensics 项目负责人 Matthew Turek 表示,他们在GAN生成的假脸中发现了一些细微的线索,由此检测出图像或视频中的脸是真实的还是AI生成的。

还记得2016年,“3.15晚会”让一张照片“骗过”人脸识别软件,从而让“人脸识别”一夜走红大江南北。

如今,更加高级的AI变脸技术和侦测AI变脸技术,也将展开一场长期艰苦,但也精彩卓绝的AI军备竞赛。

在2016年“3·15”晚会现场,主持人使用了一项 AI 技术,把静态的照片转化成动态照片,从而骗过登录系统。这一技术在手机上就能实现

就看谁能走得更好更快。

美国防部研发出首款“反AI变脸”刑侦工具:准确率高达99%

DARPA 的这款工具主要是基于纽约州立大学奥尔巴尼分校教授Siwei Lyu和他的学生 Yuezun Li和 Ming-Ching Chang 的共同发现,也即使用AI技术生成的假脸(一般通称 DeepFake),极少甚至不会眨眼,因为它们都是使用睁眼的照片进行训练的。

“由于大多数训练数据集都不包含闭眼的人脸图像,因此AI生成的人脸缺乏眨眼功能,”Lyu说:“因此,缺少眨眼是判断一个视频真假的好方法。”

论文详细介绍了他们如何组合两个神经网络,从而更有效地揭露哪些视频是AI合成的。这些视频往往忽略了“自发的、无意识的生理活动,例如呼吸、脉搏和眼球运动”。

通过有效地预测眼睛的状态,准确率达到99%。

“我们还需要探索其他深度神经网络架构,以便更有效地检测闭眼,“Lyu补充说:“我们目前的方法仅使用缺乏眨眼作为检测AI篡改的提示。然而,也应考虑动态的眨眼模式——太快或频繁眨眼,这种在生理上不太可能出现的现象也应该被视为篡改的迹象。”

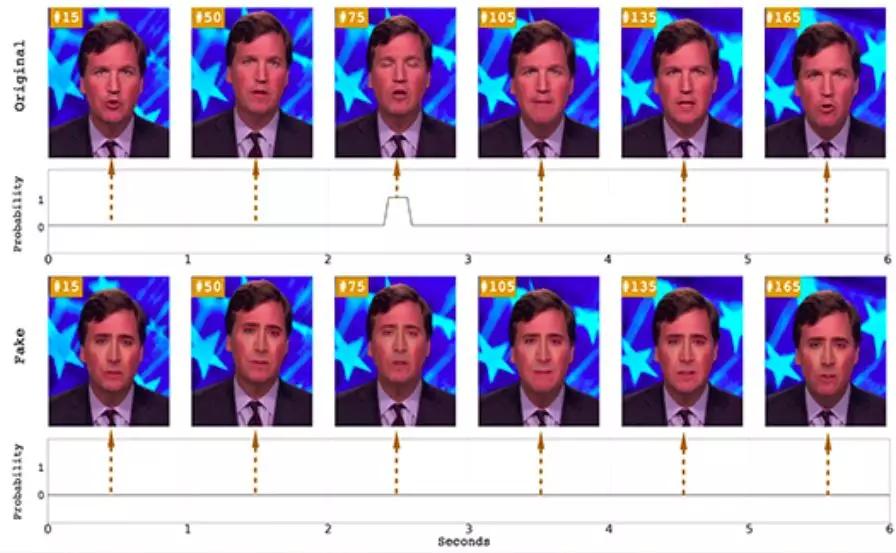

UAlbany的一组研究人员使用原始视频上的眨眼检测(上图)和DeepFake生成的假视频(下图)来确定视频是否是AI伪造的。在原始视频中,在6秒内检测到眨眼动作。来源:UAlbany.edu

参与DARPA挑战赛的其他人也在探索类似的技巧,比如自动检测奇怪的头部动作、奇怪的眼睛颜色等等。

达特茅斯大学的数字取证专家Hany Farid 表示,目前的AI反变脸工具主要利用利用这类生理信号,至少目前为止这些信号是很难被模仿的。

这些AI刑侦取证工具的带来仅仅标志着AI视频伪造者和数字刑侦人员之间AI军备竞赛的开始。

Hany Farid 表示,目前的一个关键问题是,机器学习系统可以接受更先进的训练,然后超越当前的反变脸工具。

DARPA“反AI变脸计划”:确保侦测到最先进的AI造假技术

DARPA 资助的 Media Forensics 计划,旨在成功辨别由机器学习算法生成的虚假图片和视频。研究人员试图开发出一种可扩展的平台化工具,对尤其是基于GAN 模型的“Deepfake”生成的假视频和图像进行识别。

Deepfake很多时候会被用于生成一些明星或政客的恶搞视频或剪辑,但也可能被用来恶意传播虚假消息,以达到煽动和制造混乱等危险目的。

检测数字化内容的真假通常涉及三个步骤:

首先是检查数字文件中是否有两个图像或视频拼接在一起的迹象;

第二是检查图像的光照度等物理属性,查找可能存在问题的迹象;

第三步最难自动完成的,也可能是最棘手的,就是检查图像或视频内容在逻辑上是否存在矛盾,比如图像显示拍摄日期的天气与实际天气不符,或者拍摄位置的背景有问题等。

目前,对大量真假难辨的数字化内容进行辨别的工具或应用仍缺乏广泛的适用性,在涉及到取证、证据分析和鉴别等关系重大的应用方向上,这类工具的可扩展性和稳健性都无法完全满足实务中的需求。

DARPA的MediFor项目汇集了世界级的研究人员,试图开发出能够自动评估图像或视频完整性的技术,并将这些技术集成到端到端平台上。如果该项目获得成功,MediFor平台将能够自动检测对图像或视频的改动,并给出详细信息,说明具体是如何改动的,以及判断视频是否完整的理由,以便于决定是否能够将可疑图像或视频作为证据使用。

DARPA该项目负责人David Gunning表示:“从理论上讲,如果你用现阶段的全部技术来探测GAN生成的虚假结果,它就能学会绕开这些检测技术。”不过,研究人员在对抗Deepfake时发现了一个重要弱点,它生成的假视频中的人从来都不眨眼,这是一个重要特征。这是因为Deepfake用于生成的假视频的训练模型都是静止的图片,而人在拍照时,绝大多数情况下眼睛总是睁开的。

DARPA的研究人员表示,该机构将继续进行更多测试来“确保开发中的识别技术能够检测到最新的造假技术。”

从Deepfake到HeadOn:换脸技术发展简史

DAPAR的担忧并非空穴来风,如今的变脸技术已经达到威胁安全的地步。最先,可能是把特朗普和普京弄来表达政治观点;但后来,出现了比如DeepFake,令普通人也可以利用这样的技术制造虚假色情视频和假新闻。技术越来越先进,让AI安全也产生隐患。

1、Deepfake

我们先看看最大名鼎鼎的Deepfake是何方神圣。

Deepfake即“deep learning”和“fake”的组合词,是一种基于深度学习的人物图像合成技术。它可以将任意的现有图像和视频组合并叠加到源图像和视频上。

Deepfake允许人们用简单的视频和开源代码制作虚假的色情视频、假新闻、恶意内容等。后来,deepfakes还推出一款名为Fake APP的桌面应用程序,允许用户轻松创建和分享换脸的视频,进一步把技术门槛降低到C端。

特朗普的脸被换到希拉里身上

由于其恶意使用引起大量批评,Deepfake已经被Reddit、Twitter等网站封杀。

2、Face2Face

Face2Face同样是一项引起巨大争议的“换脸”技术。它比Deepfake更早出现,由德国纽伦堡大学科学家Justus Thies的团队在CVPR 2016发布。这项技术可以非常逼真的将一个人的面部表情、说话时面部肌肉的变化、嘴型等完美地实时复制到另一个人脸上。它的效果如下:

Face2Face被认为是第一个能实时进行面部转换的模型,而且其准确率和真实度比以前的模型高得多。

3、HeadOn

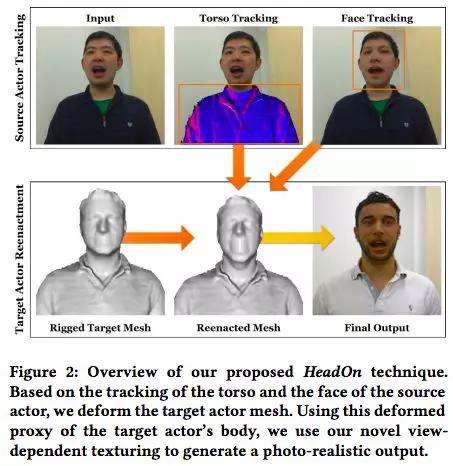

HeadOn可以说是Face2Face的升级版,由原来Face2Face的团队创造。研究团队在Face2Face上所做的工作为HeadOn的大部分能力提供了框架,但Face2Face只能实现面部表情的转换,HeadOn增加了身体运动和头部运动的迁移。

也就是说,HeadOn不仅可以“变脸”,它还可以“变人”——根据输入人物的动作,实时地改变视频中人物的面部表情、眼球运动和身体动作,使得图像中的人看起来像是真的在说话和移动一样。

HeadOn技术的图示

研究人员在论文里将这个系统称为“首个人体肖像视频的实时的源到目标(source-to-target)重演方法,实现了躯干运动、头部运动、面部表情和视线注视的迁移”。

HeadOn的视频演示:

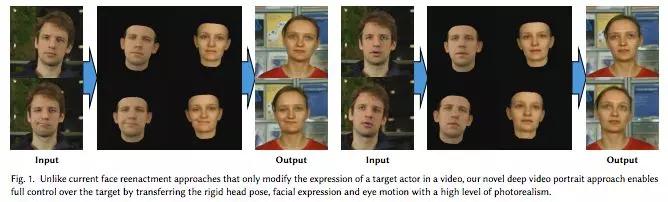

4、Deep Video Portraits

Deep Video Portraits是斯坦福大学、慕尼黑技术大学等的研究人员提交给今年8月SIGGRAPH大会的一篇论文,描述了一种经过改进的“换脸”技术,可以在视频中用一个人的脸再现另一人脸部的动作、面部表情和说话口型。

例如,将普通人的脸换成奥巴马的脸。Deep Video Portraits可以通过一段目标人物的视频(在这里就是奥巴马),来学习构成脸部、眉毛、嘴角和背景等的要素以及它们的运动形式。

5、paGAN:用单幅照片实时生成超逼真动画人物头像

最新引起很大反响的“换脸”技术来自华裔教授黎颢的团队,他们开发了一种新的机器学习技术paGAN,能够以每秒1000帧的速度对对人脸进行跟踪,用单幅照片实时生成超逼真动画人像,论文已被SIGGRAPH 2018接收。具体技术细节请看新智元昨天的头条报道。

Pinscreen拍摄了《洛杉矶时报》记者David Pierson的一张照片作为输入(左),并制作了他的3D头像(右)。 这个生成的3D人脸通过黎颢的动作(中)生成表情。这个视频是6个月前制作的,Pinscreen团队称其内部早就超越了上述结果。