人工智能秘史(五):诞生于1980年代的算法偏见

神译局是36氪旗下编译团队,关注科技、商业、职场、生活等领域,重点介绍国外的新技术、新观点、新风向。

编者注:AI史的叙述方式往往是机器随时间转移而变得越来越聪明。但这种叙述缺少了人的要素,没有讲清楚智能机器是如何由人的身体和思想来设计、训练与赋能的。

为此,IEEE推出了总共六篇的AI秘史系列文章,希望从创新者、思想家、工人甚至小贩等人如何创造可复制人类思想和行为的算法的角度来弥补这一缺失。尽管无需人类输入的超智计算机令人兴奋,但智能机器的真正历史已经证明,AI的水平只能跟我们一样的好。此文为系列的第五篇,作者是 Oscar Schwartz,原文标题为:Untold History of AI: Algorithmic Bias Was Born in the 1980s

AI秘史(一):查理•巴贝奇与会下棋的土耳其机器人

AI秘史(二):美国第一台电子计算机背后的女性程序员

AI秘史(三):为什么图灵希望AI代理犯错

AI秘史(四):憧憬人机共生的DARPA梦想家

第五部分:Franglen的招生算法

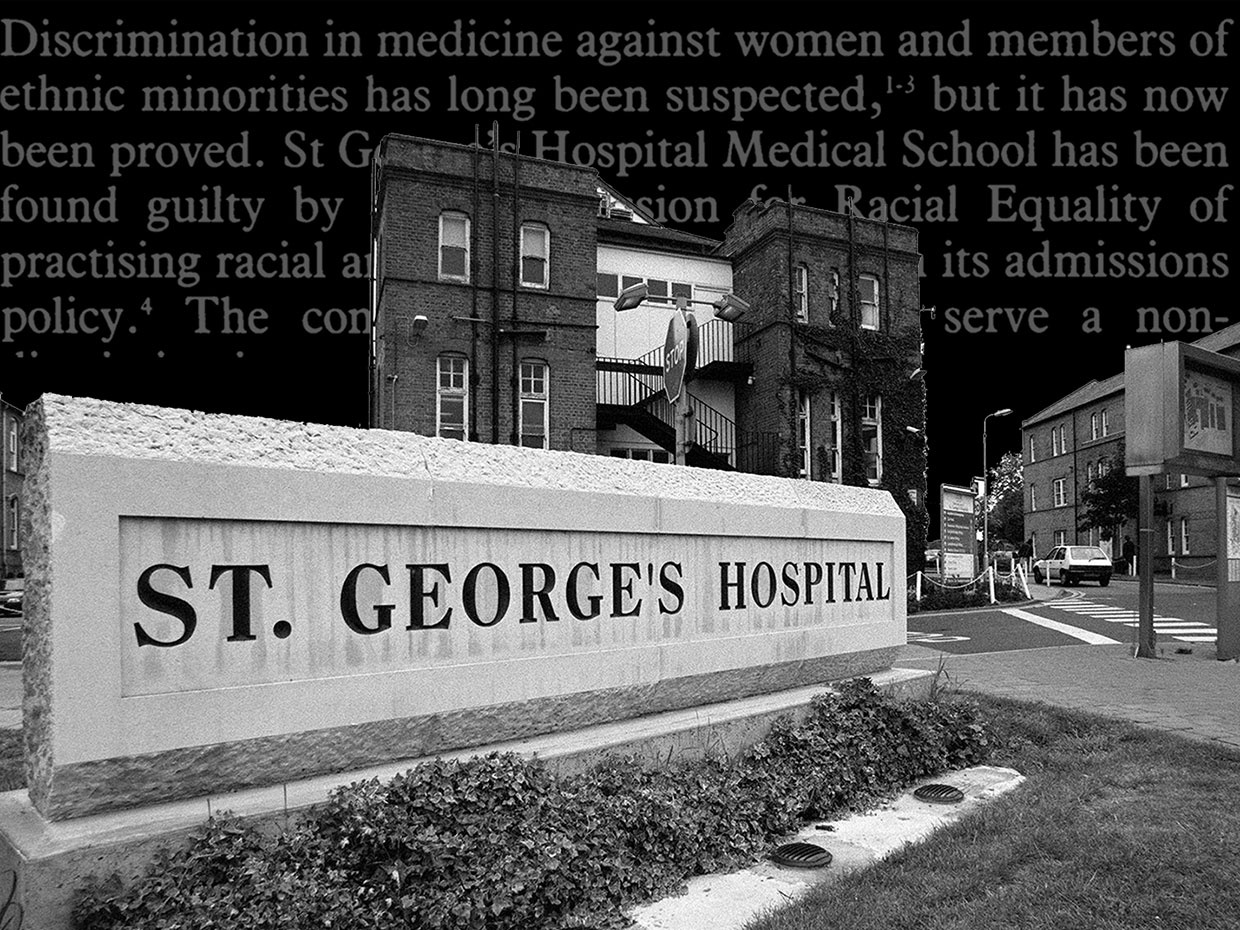

1970年代,伦敦圣乔治医学院的Geoffrey Franglen博士开始编写一个算法来筛选学生的入学申请。

当时,圣乔治每年2500份申请中有3/4只是因为书写的申请就被学术评估人拒绝了,都没有进入到面试阶段。通过初步筛选的人当中约有70%最后拿到了医学院的录取名额。所以初步的“淘汰”轮非常关键。

Franglen是圣乔治医学院的副院长,而且他本人就是招生评估员。看申请是一项非常耗时的任务,他觉得这可以自动化完成。他研究了自己和同事筛选学生的过程,然后写了一个程序,用他的话来说,这个程序“模仿了人类评估员的行为。”

尽管Franglen的主要动机是提高招生流程的效率,但他也希望消除招生人员在旅行职责当中的不一致。其想法是将职责交给技术系统,所有的学生申请都要遵循完全一样的评估过程,从而创造一个更公平的流程。

但其实结果恰恰相反。

1979年,Franglen完成了算法。那一年,学生申请要经过计算机与人类评审员的双重测试。Franglen发现,这套系统跟筛选委员会的评分有90%到95%的一致率。在医学院的管理层看来,这一结果证明了算法可以取代人类筛选员。到1982年,圣乔治医学院的所有初选工作都交给程序来完成了。

如果他们的名字不是白人姓氏的话,筛选流程就会不利于他们。实际上,光是没有一个欧洲名字就会自动扣除申请者15分了。

不出几年,学校的职工就对成功申请者当中缺乏多样性感到担忧。他们对Franglen的程序进行了内部审核,注意到系统的特定规则似乎以一些不相干的因素,比如出生地和姓名来权衡申请者。但Franglen向委员会保证,这些规则源自之前招生趋势收集到的数据,对筛选只会产生很小的影响。

1986年12月,圣乔治医学院的两位资深讲师听说了这次内部审核的事情,然后找到了种族平等委员会。他们告诉委员们说,他们有理由相信这套计算机程序被偷偷用于对女性和有色人种进行歧视。

该委员会于是启动一项调查。结果调查发现,候选人被算法按照名字和出生地分成了“白人”或者“非白人”。如果他们的名字不是白人姓氏,筛选流程就会对他们不利。实际上,光是没有一个欧洲名字就会自动扣除申请者15分了。委员会还发现,女性申请者平均要被扣掉3分。算下来,每年大概有多达60位申请者被这套评分系统拒绝了面试。

在当时,英国大学的性别和种族歧视还非常猖獗——圣乔治医学院之所以被逮住是因为它把偏见供奉到了一个计算机程序里面。因为算法给女性和名字非欧洲化的人更低的分数是可验证的,委员会就有了歧视的具体证据。

委员会认定,圣乔治医学院要为招生政策中存在的歧视性做法负责,但因为没有造成严重后果而逃脱了罪责。为了表现出一点补偿的诚意,医学院联系了可能受到不公正歧视的人,3名此前申请被拒的学生后来被补录进来了。委员会指出,医学院的问题不仅仅是技术性的,而且也是文化上的。很多教职员工都将录取机器视为没有问题,因此并没有花时间去询问如何鉴别学生的问题。

从更深层次来看,算法只是在维持招生系统早已存在的偏见而已。毕竟,Franglen已经拿这台机器跟人比较过,发现结果的相关性达到了90-95%。但是由于他把筛选员的歧视做法编码到技术系统里面,就导致了这些偏见会一而再再而三地持续下去。

圣乔治医学院的歧视引起了极大的的关注。后来,委员会裁定该校的招生表格里面含有种族和种族划分的信息。但是这不痛不痒的一部并不能阻止算法偏见的暗流涌动。

的确,随着算法决策系统日益渗透到医疗保健和司法审判等高风险领域,基于历史数据而产生的原有社会偏见的长期存在和扩散已经成为一个巨大的问题。2016年, ProPublica的调查记者披露全美用于预测未来犯罪情况的软件对非洲裔美国人存在偏见。最近,研究学者Joy Buolamwini证明了美国的脸部识别软件对黑肤色的女性有着更高的错误率。

尽管机器偏见正在快速成为AI领域被讨论得最多的话题之一,算法仍经常被看成是是产生理性、不带偏见结果的数学的不可理解的、毋庸置疑的对象。正如AI批评人士Kate Crawford所说那样,是时候把算法看作是“人类设计的创造物”了,而自然它会继承我们的偏见。算法不可置疑的文化迷思往往掩盖了这样一个事实:我们的AI只会跟我们一样好。

原文链接:https://spectrum.ieee.org/tech-talk/tech-history/dawn-of-electronics/untold-history-of-ai-the-birth-of-machine-bias

译者:boxi