AI 应用调查报告:85%企业支持,人才短缺成为障碍

编者按:O’Reilly最近又对AI行业发起调查,并编写成报告,最新趋势告诉我们,AI正在从原型走向生产。虽然AI产业进步神速,但障碍仍然存在,比如人才稀缺、制度支持力度不够。本文编译自原题为“AI adoption in the enterprise 2020”的文章。

去年,我们感觉到大家对AI的兴趣已经接近狂热,所以我们就AI应用发起调查。调查完成之后我们分析结果,认为AI行业处在快速变化的阶段,所以我们又发起一次调查,想搞清眼下AI主要应用于哪些行业。

调查花了几周时间,也就是2019年12月的几周,收到1388份回应报告。最新的调查告诉我们在企业领域AI应用到了怎样的程度(已经从原型向生产阶段过渡),调查还涉及具体技术和工具的流行程度,应用者面临怎样的挑战,以及其它一些问题。

下面让我们总结一下:

关键调查结果:

——约有85%的受访机构声称它们正在评估AI,或者将AI应用于生产。只有15%的机构在AI方面没有采取任何行动。

——超过一半的受访机构是“AI技术成熟的应用者”,换言之,它们正在用AI完成分析、生产任务。

——在成熟AI应用者中,监督式学习是最流行的机器学习技术,在那些仍在评估AI的机构中,机器学习是最流行的技术。

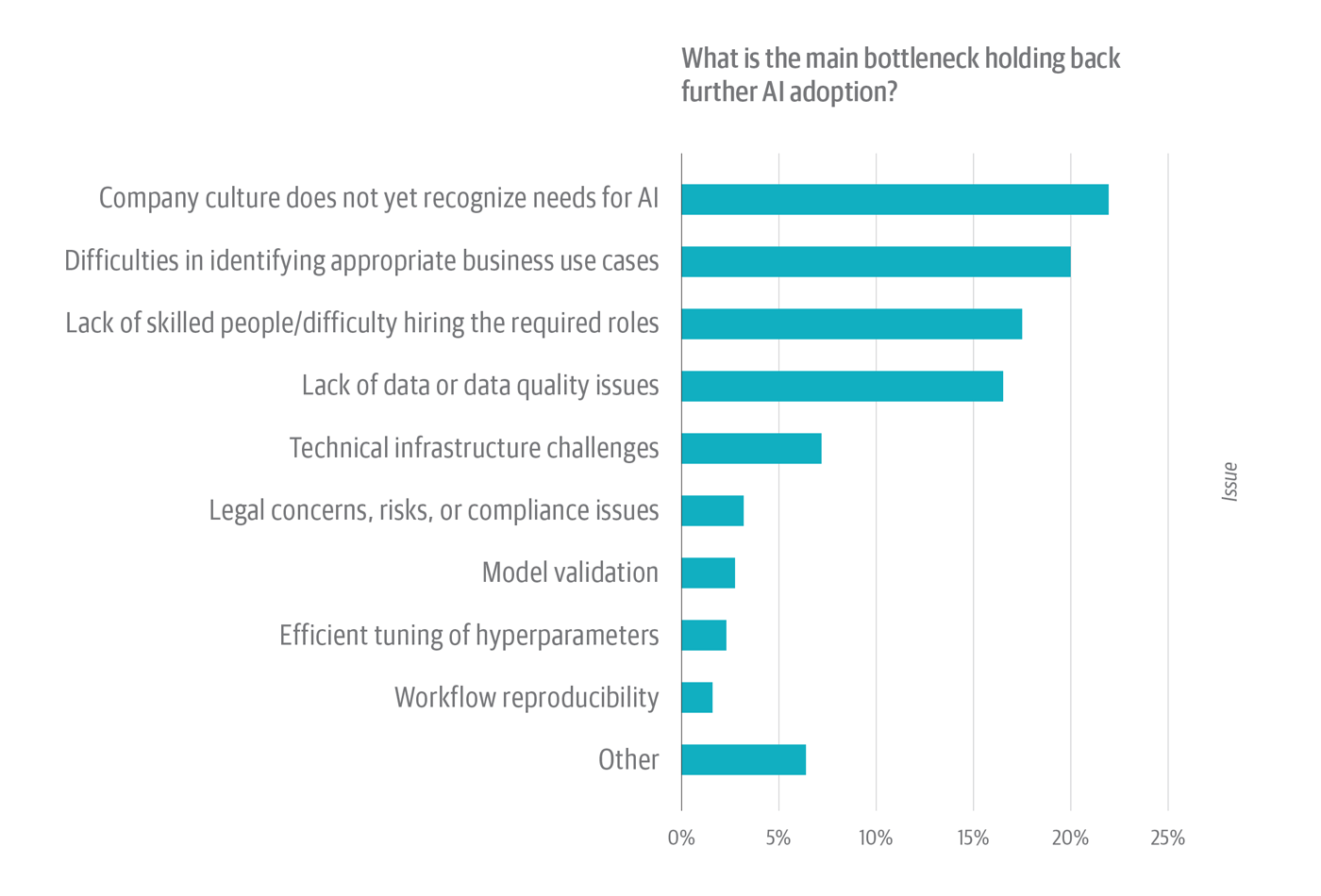

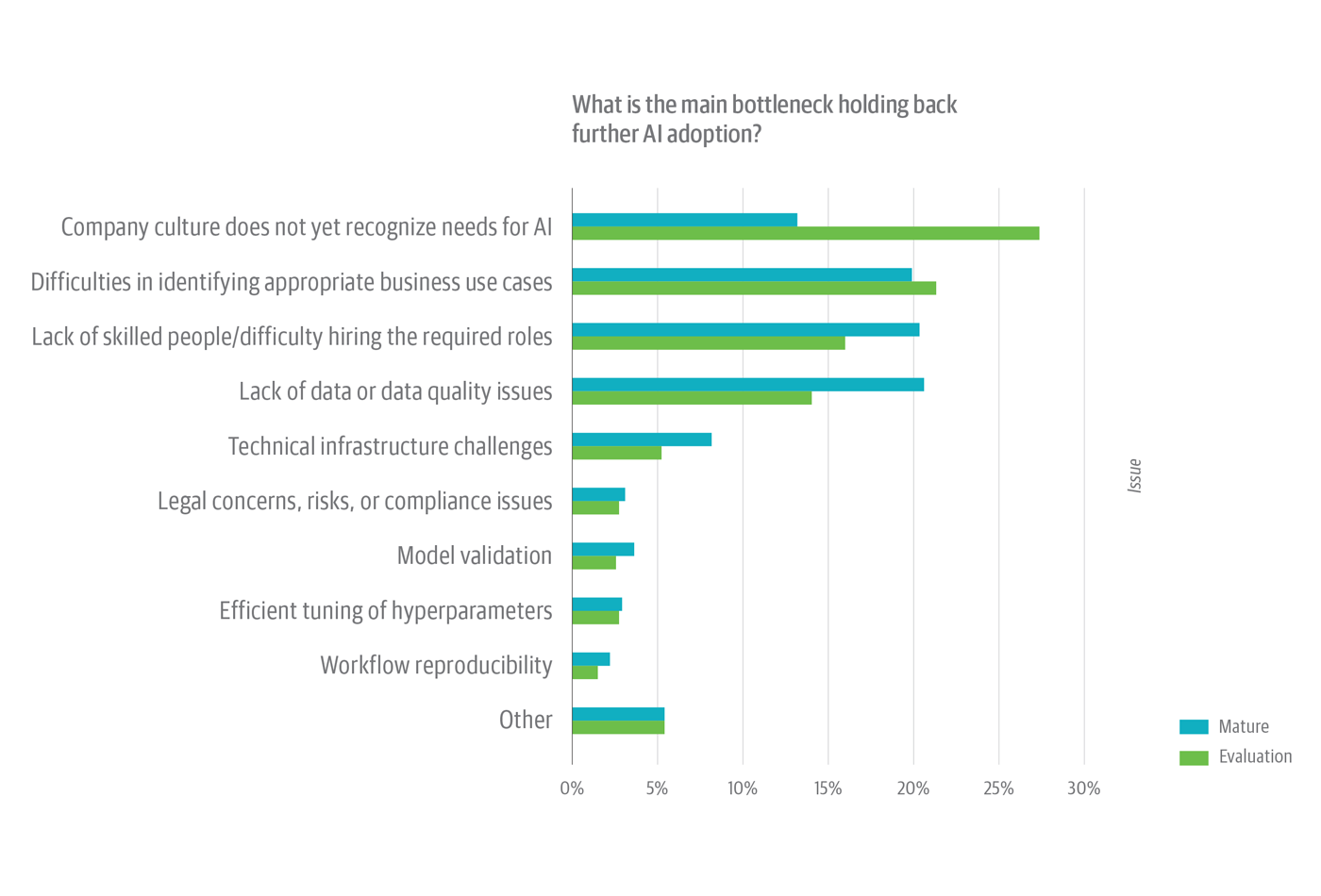

——在AI应用时,缺少机器学习和AI技能并不是最大障碍。22%的受访者认为,缺少制度支持是最大问题。

——只有很少的企业用正式治理控制手段为自己的AI活动提供支持。

AI仍然在发展。有许多企业正在评估AI,用AI做实验,不过在应用时,主要用于“生产部署”(production deployments)。这种发展仍然处在初期阶段,企业还要做很多工作才能让AI变得更坚固。不论怎样,应用者为了打造稳定的AI生产线,还有一大堆工作要做。

受访者分布

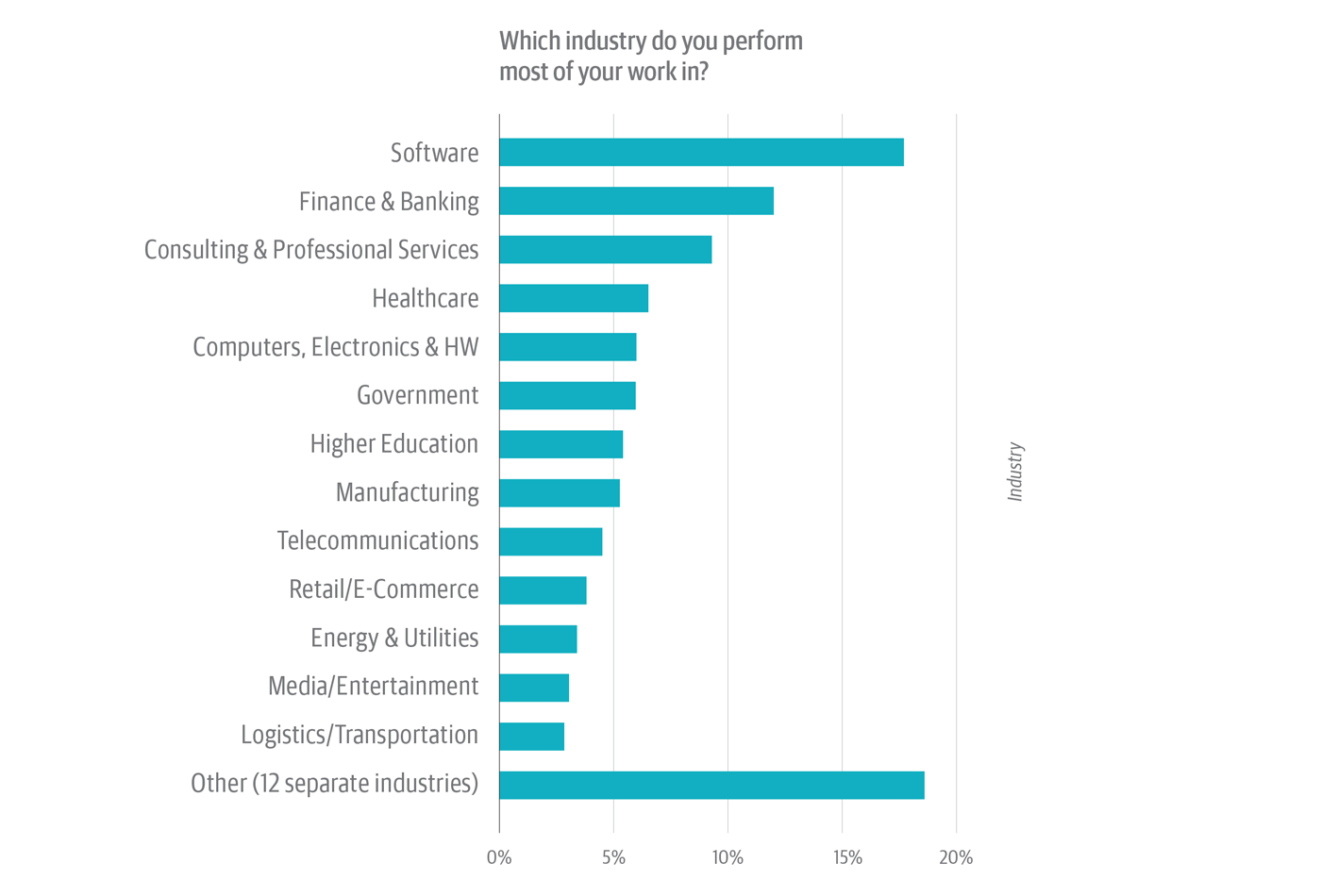

受访者代表所在机构和企业接受调查,他们来自25个行业,来自软件行业的受访者占17%。从受访样本看,“科技行业”所占的比重并不是很高,“计算机、电子、硬件”也属于科技行业的重要板块,它只占了样本的7%还不到。至于“其它”类别,它包括12个行业,占受访者的22%。

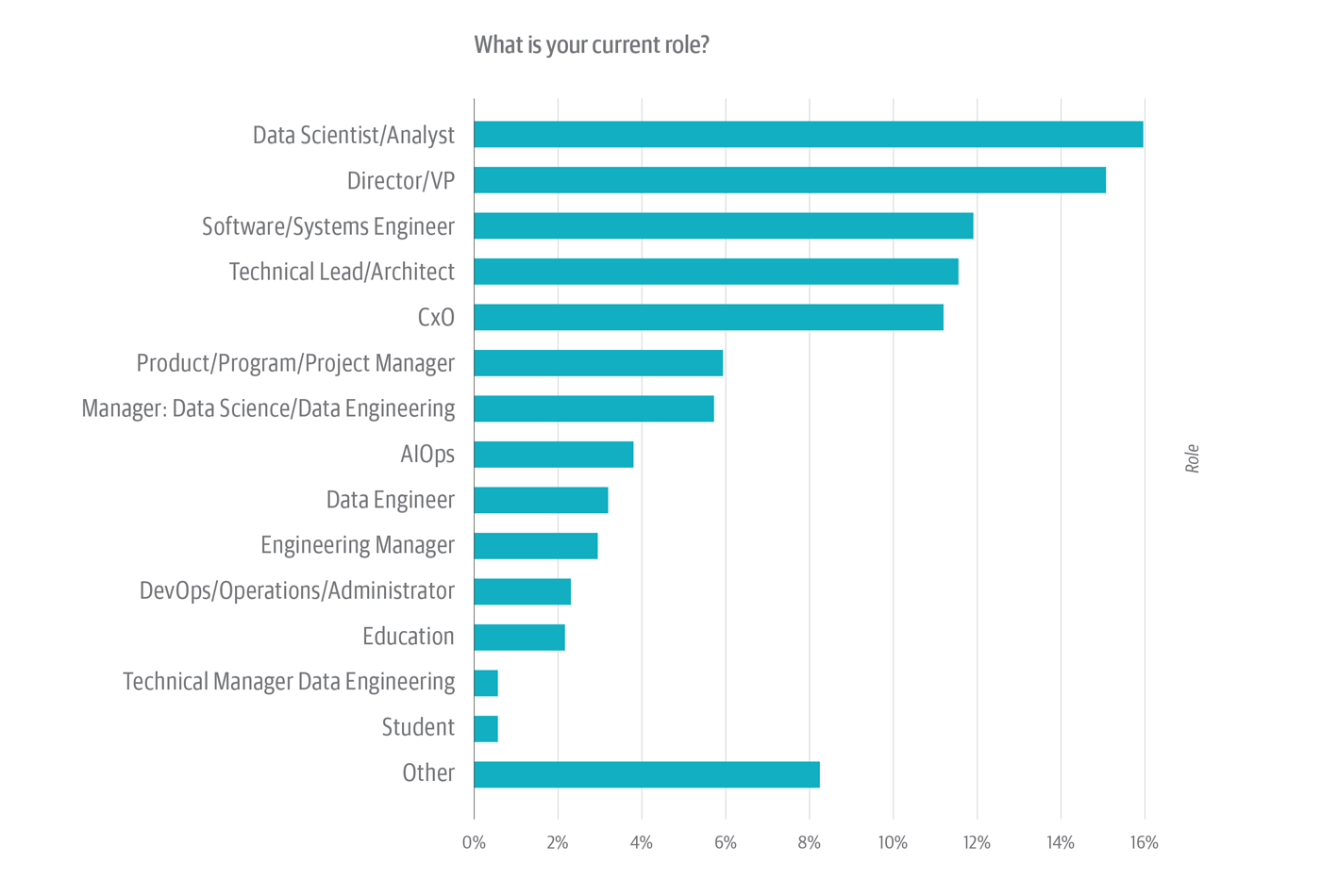

数据科学家占主导,企业高管具有代表性

大约六分之一的受访者是数据科学家,高管(比如主管、副总裁、CxO)占了样本的26%。从调查看,受访者的确严重偏向数据,有30%的受访者是数据科学家、数据工程师、AIOps工程师,或者是管理他们的人。大约四分之三的受访者宣称自己从事的工作与数据有关。在所有受访者中,超过70%从事科技类工作。

地区分布

约有50%的受访者来自北美,其中大多来自美国,美国受访者占了40%。然后是西欧受访者,占了23%,亚洲占15%。南美、东欧、大洋洲、非洲占15%。

分析:今天的AI应用现状

在受访者代表的机构中,超过一半在AI应用方面已经进入“成熟”阶段,也就是用AI分析、生产,还有大约三分之一正在评估。再看去年的AI调查结果,54%的受访机构声称在评估AI,只有27%进入“成熟”阶段。在2020年的调查中,只有15%的受访机构没有设立任何AI项目。

约有85%的机构正在使用AI,当中大多用于生产,这是一个值得关注的亮点。似乎2019年制定的实验性AI项目今年开始开花结果。

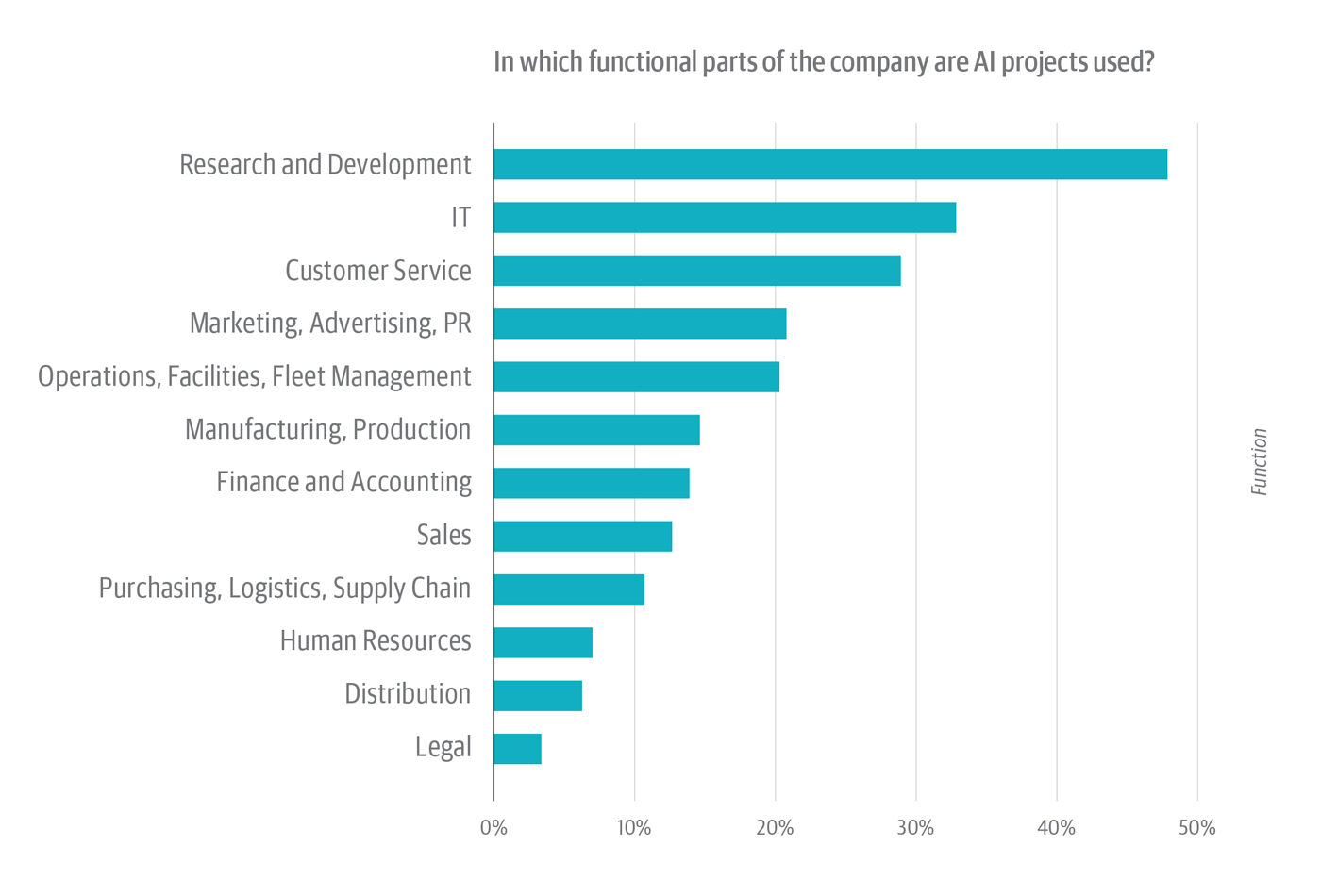

AI主要用在哪里呢?约有一半受访者说他们用在研发领域,排名第二的是IT,有三分之一的受访者选择(请注意,这里可以多选)。

在选项中有两个属于企业的“功能部门”,也就是“营销/广告/PR”和“运营/设施/车队管理”,每个都有大约20%的受访者选择。由此可以看出,受访机构看到了AI在功能部门的价值。

采用AI面临的挑战

在大多机构内,获得并保留AI特殊技能仍然是AI应用的一大障碍。今年,约有超过六分之一的受访者声称招募并留下AI人才是AI应用的一大障碍。2019年,大约只有18%的受访者这样认为。

但是缺少高技能人才并不是最大障碍。2020年,大约22%的受访者认为缺少机构支持才是最大问题,2019年也有很多人这样认为。2019年和2020年,在AI应用的各大障碍中,“缺少高技能人才、很难招到必要人才”排在第三位;“难以确认合适的商务用例”排在第二位,约有20%的受访者选择。

AI/ML技能短缺

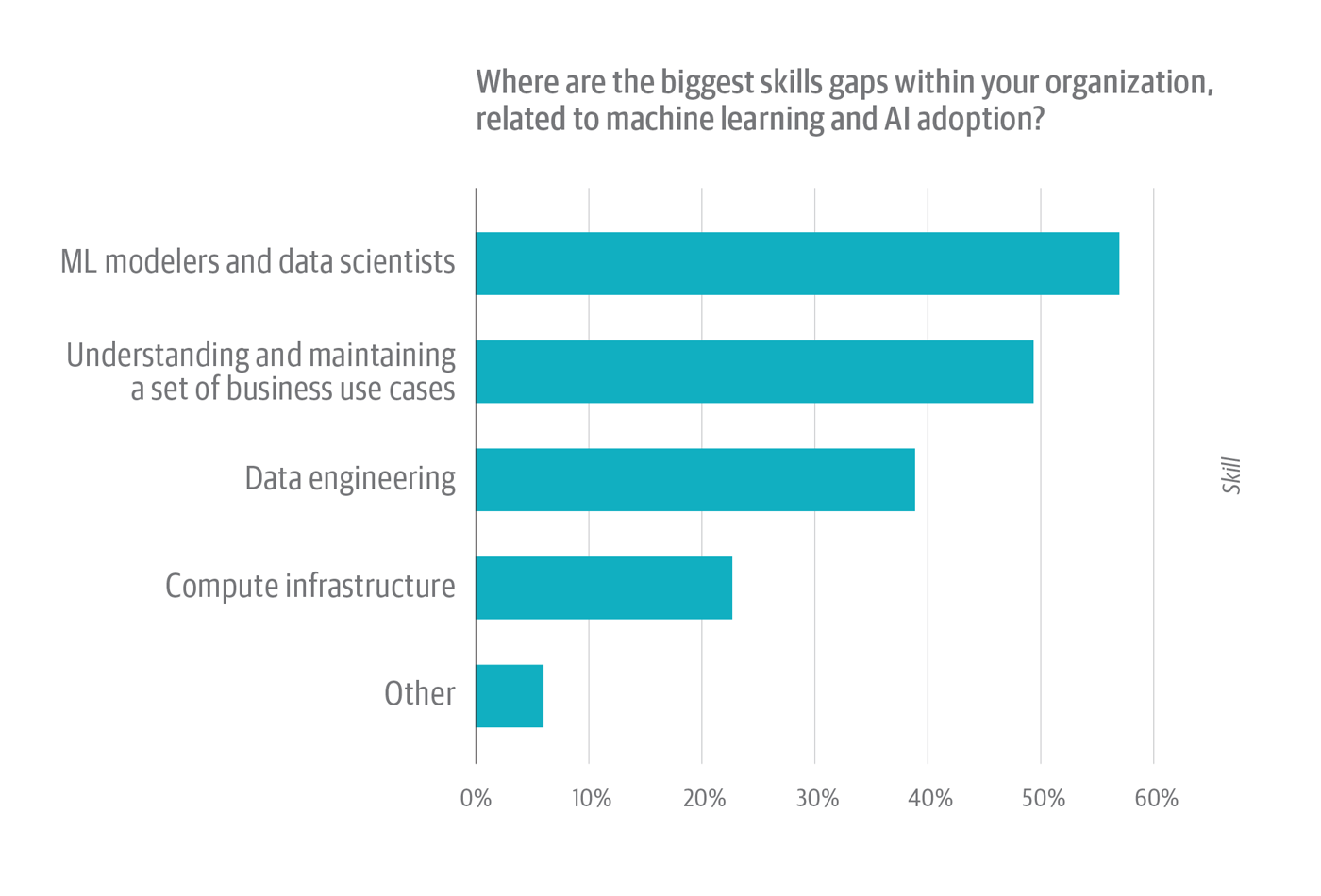

我们还问调查者:在他们的机构中,哪些机器学习(ML)和AI技能最欠缺。58%的受访者认为最欠缺ML模型师、数据科学家,选择的人最多。理解及维护一系列商务用例排在第二位,约有一半人选择。还有40%的受访者选择“在数据工程领域缺少必要技能”。最后,还有约四分之一的人选择“机构缺少计算基础设施技能”。

这项调查有一个地方很有趣:2020年的结果和2019年惊人相似。2019年的问题到了2020年仍然是问题,比例也基本一样。2019年,57%的受访者选择“缺少机器学习建模和数据科学专家”,今年的比例是58%。这些技能都是机构必需的,而且不太容易解决。例如,数据科学家是“混合物种”,不但要掌握精深的理论、技术知识,还要具备面向特定领域的实际商业知识。

可惜,很多数据科学家缺少实践,所以机构只能在工作中对新晋数据科学家培训。正因如此,才会有那么多受访者认为:严重缺少理解和维护特定商务用例的人才是一大问题,2019年有47%的受访者选择,今年上升到49%。数据科学家利用自己掌握的特定专业知识为AI找到适合的商务用例。机器学习建模师在实践中积累知识,然后用这些特定商业知识补充技术知识。这两种类型的从业者都需要提升软技能,在团队工作、倾听、移情过程中提升。提升需要时间,也是经验的结果。

管理AI/ML风险

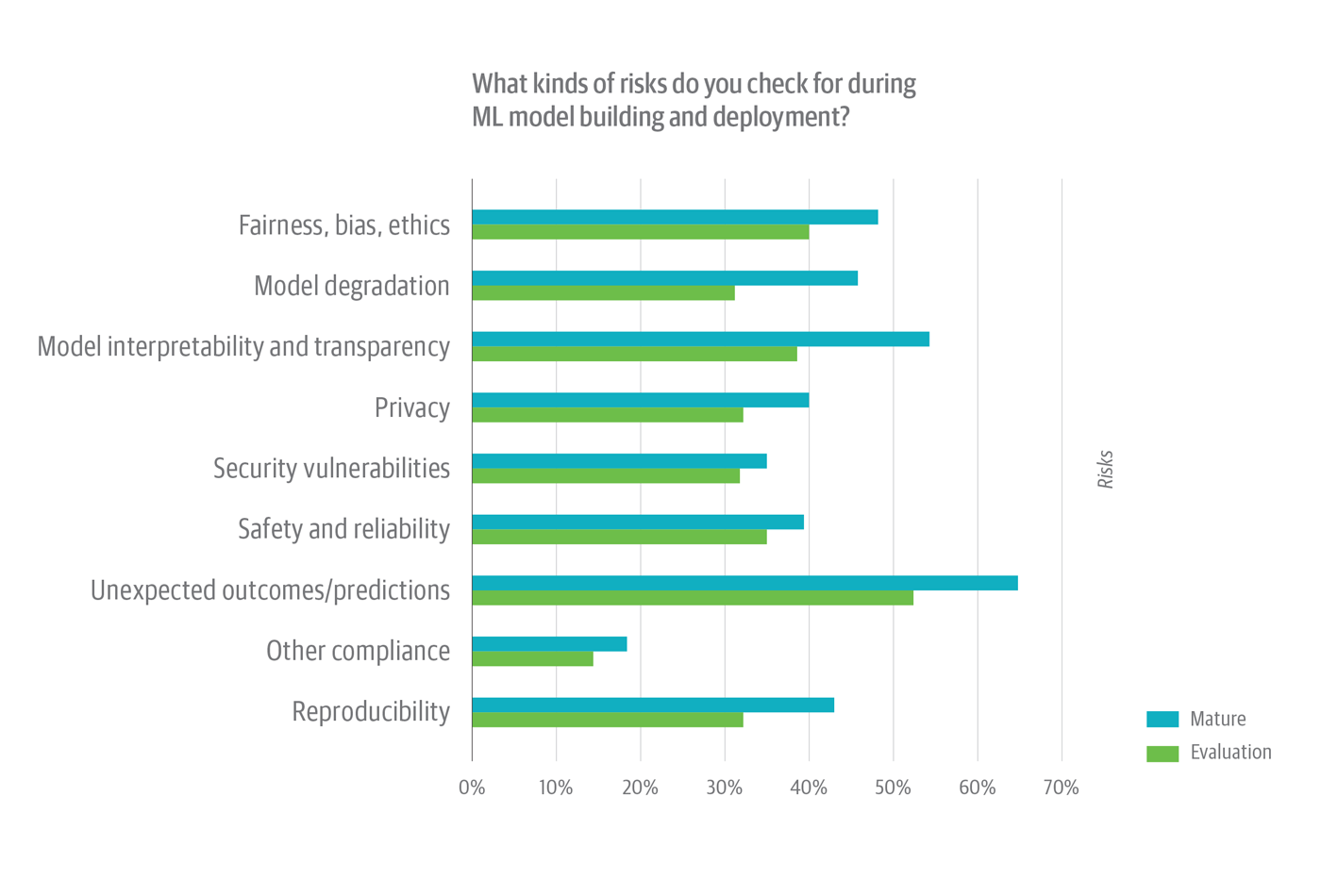

我们还问了受访者这样一个问题:当你们搭建部署ML模型时有哪些风险需要控制(多选)?调查结果显示,所有机构(尤其是AI项目处于“成熟”阶段的机构)全都认为应该警惕设计使用ML/AI技术的内在风险。

在“成熟”机构中,大约有三分之二的人选择“意料之外的结果/预测”,这是最大的单一风险因素。在“成熟”机构中,排名第二的单一风险因素是“对ML模型的可解释性和透明度进行控制”,约有55%的人选择;至于“正在评估”的机构,公平、偏见和道德风险排在第二位,有40%的人选择。在“成熟”机构眼中,公平、偏见和道德风险排在第三位,有48%的受访者选择。与正在评估的企业相比,“成熟”机构更愿意对模型退化进行检查,所以在“成熟”机构中,AI模型退化是是第四大风险因素(约46%的人选择)。

在调查时给出的选项有9个,因为是多选,受访者可以全部选择。我们发现,41%的受访者至少选择了4个,61%的受访者至少选择3个。

监督式学习成主导、深度学习持续升温

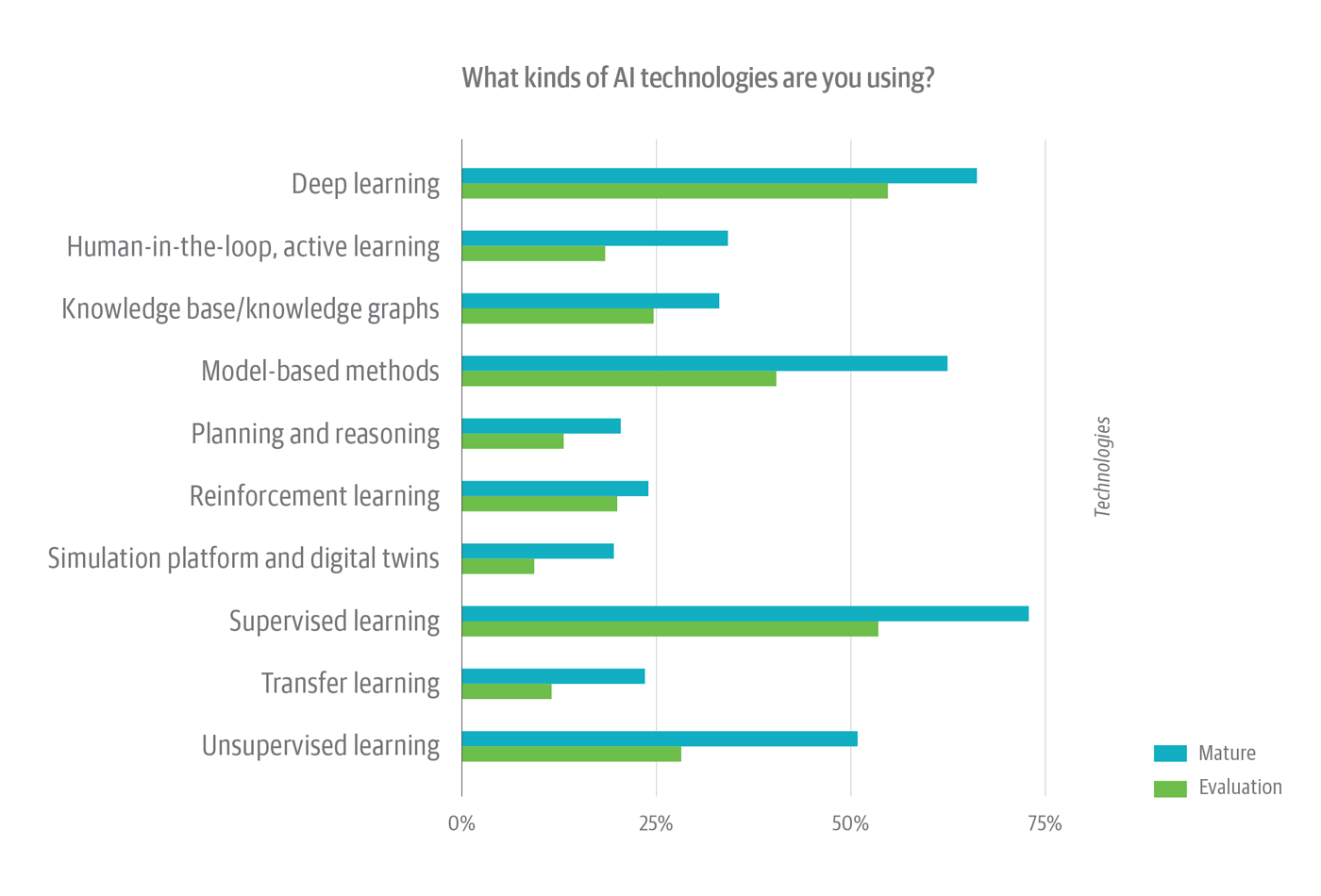

在所有AI应用者中,监督式学习技术仍然是最流行的ML技术。2019年,超过80%的成熟应用者已经使用这种技术,当时约有三分之二的受访机构还处在评估阶段。到了2020年,约有73%的成熟AI活动已经使用监督式学习技术。

有一点需要注意,2020年,对于那些处于评估阶段的机构来说,深度学习技术已经取代监督式学习技术成为最流行的技术。数据可以说明一切:对于正在评估AI的机构,有55%声称他们正在使用深度学习技术,有54%声称正在使用监督式学习技术(多选)。对于成熟的AI应用者,约有66%的受访者声称他们正在使用深度学习技术,排在第二位,排在第一的是监督式学习技术。

与正在评估的组织相比,在成熟接受者中,ML或者AI技术的使用率更高。换言之,二者有着很大的区别。例如,在成熟接受者中,大约23%的AI活动用到了迁移学习(Transfer learning)技术,而评估者只有12%。另外,在成熟者中机回圈(Human-in-the-Loop)AI模型更加流行。

在工作中选择什么工具呢?78%的受访者选择至少2种ML技术,59%选择至少3种,39%至少选择4种。

主导性工具越来越重要

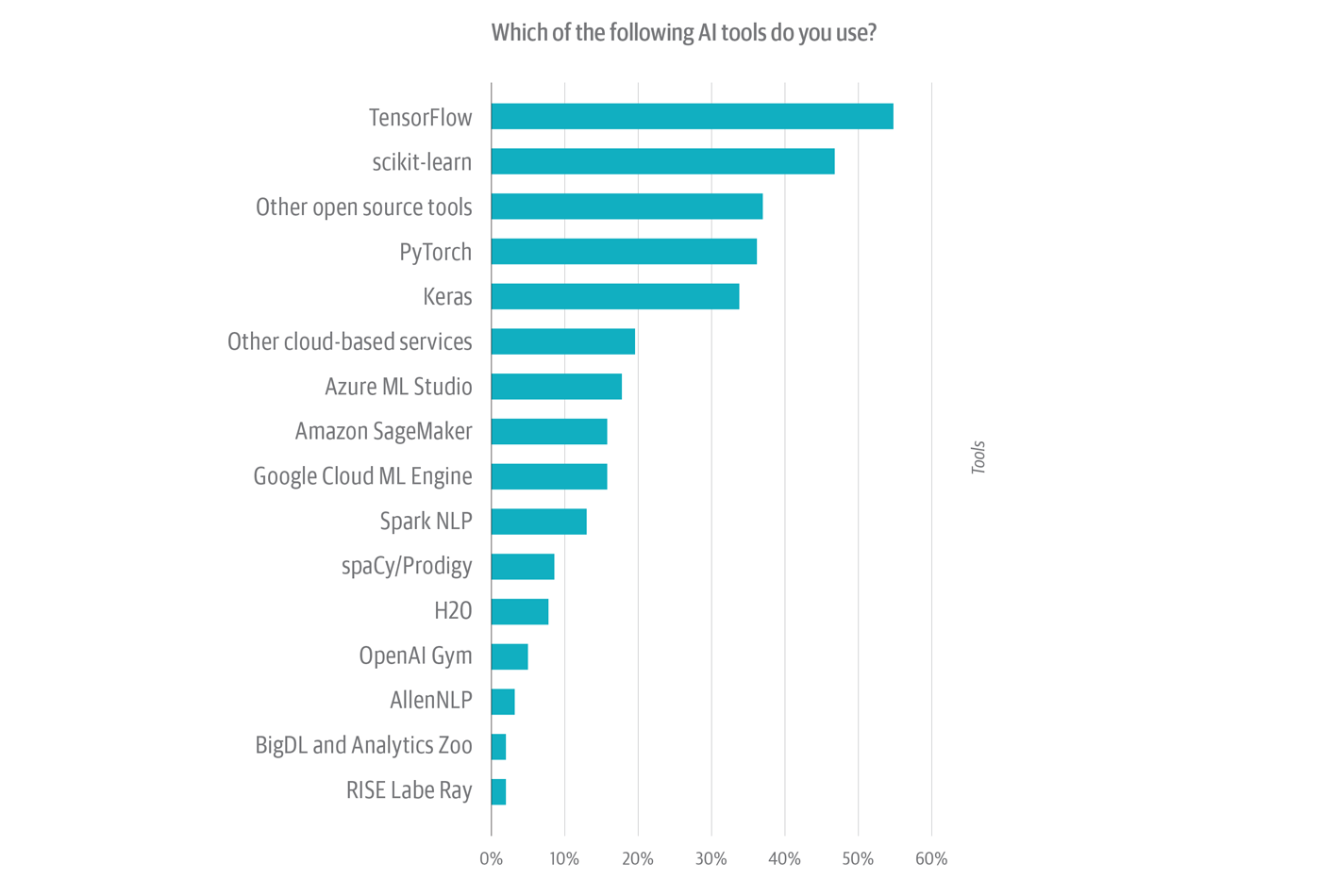

在Ai工作中,TensorFlow仍然是最流行的工具。2019年和2020年,大约55%的受访者选择了它,比重保持不变。TensorFlow地位稳固还告诉我们一个事实:深度学习、神经网络越来越流行。

2019年最流行的AI开发工具到了2020年仍在流行。在最流行的5种AI工具中,有4种要么以Python作为基础,要么以Python作为主导。TensorFlow、Scikit-learn和Keras 保持稳定,PyTorch份额增长,达到36%。

数据治理还不是当务之急

有超过五分之一的受访机构宣称,它们引入了正式数据治理流程和(或)工具,用来支持或者补充AI项目。

26%的受访者回应称会在2021年之前引入正式数据治理流程和(或)工具,35%预计会在未来3年引进,这是好消息。也有坏消息,AI接受者认为数据治理只是补充,并非基本要素。

数据溯源(Data provenance)、数据沿袭 ( data lineage ) 、一致性数据定义、丰富的元数据管理及其它良好的数据治理技术将会融入AI项目,并非叠加在AI项目之上。

我们可以将数据治理看成是软件开发过程中的“可观察性”(observability)部分:翻新已有系统让它具备可观察性是很难的,将可观察能力植入系统倒是容易一些。同样的,为系统或者服务建立数据治理能力容易一些,事后添加难一些。

要点汇总

回看调查报告我们总结一些要点,机构在推进AI项目时可以参考:

——如果没有制定计划对AI进行评估,那你是时候迎头赶上了。现在市场上有很多开源工具、库、教程及其它,还有平易近人的通用语言(比如Python),进入AI的门槛大大降低。大多企业都在用AI做实验,落后是有风险的。

——AI项目与软件架构、基础设施、运营的主导趋势保持一致。

——你可以从更宏观的角度考虑:到处都在使用AI,不限于研发和IT。在调查中,许多受访者声称他们在客户服务、营销、运营、财务及其它领域使用AI。

——要对组织进行培育,不能只是训练模型。在AI应用过程中,制度支持仍然是最大的障碍。如果你觉得AI能带来助益,那就应该花点时间解释关键问题,比如如何保持期待、为什么可以期待、有何期待。

——在AI执行过程中会有风险存在,现在我们对风险有了更好的理解。当我们向高管、利益相关方解释,告诉他们执行AI项目时有何期待,解释起来会更容易一些。

大总结

很明显,AI正在变得成熟起来,虽然许多用例看起来很原始,但它仍然一天一天变得成熟。应用者正在采取积极措施控制常见风险。不论是成熟还是不成熟的应用者,它们都在用复杂技术做实验,开发自己的AI产品和服务。应用者使用多种ML和AI工具,但使用的语言基本只有一种,也就是广泛流行的Python。如果想扩大AI实践规模,企业还有几件事要做:解决数据治理和数据调理问题。

译者:小兵手