手机扫一扫,现实物体隔空「复制粘贴」进电脑,北大校友的AI新研究,现在变成AR酷炫应用

编者按:本文来自微信公众号“量子位”(ID:QbitAI),作者:十三白交,36氪经授权发布。

魔法变现实,酷炫又实用。

还记得两年前,Zach King(男巫)的爆红魔术吗?

不仅从纸直接蹦出一个手机,还直接扔进了电脑里形成虚拟的天猫页面。

现在,不用去羡慕男巫了,人人都可以把身边的东西“扔到”电脑里,而且一部手机就能搞定!

这就是来自34岁法国设计师Cyril Diagne的最新AR黑科技——AR Cut & Paste,将身边的事物“一键”复制粘贴到电脑上,整个完成时间不到10s。

比Ctrl+C和Ctrl+V还要爽快!

比如,拿手机扫一扫书上的模型图片,再把手机对准电脑屏幕,模型瞬间就复制到了电脑。

书上的人物也不在话下。

就有网友说道:连这个黑发小哥的头发都能识别出来,太神奇了。

当然,手写的笔记,也可以复制粘贴到电脑中。

他在Github上分享了他的AR新技术,已经狂揽7K颗小星星;而且在Reddit上分享不到14小时,就获得了近4K的点赞量。

即使Cyril表示目前仅仅能在Photoshop中实现,但未来——肯定会有更多不同的输出方式。

只是现在,这项AR黑科技——魔法一样的新技术,只要你想,也能复刻。

简单四步,开启“复制粘贴”新世界

小哥非常热心地在GitHub中,描述了AR Cut & Paste的“上手指南”。

首先要强调的是,这是一个研究原型,而不是针对消费者或者Photoshop用户的工具。

AR Cut & Paste原型包含3个独立的模块。

移动应用(The mobile app)

可以查看GitHub中/app文件夹,了解如何将App部署到手机中。

本地服务器(The local server)

手机APP与Photoshop的接口。

使用屏幕点(screenpoint)找到摄像机在屏幕上指向的位置。

可查看/server文件夹,了解关于本地服务器的配置说明。

目标检测 / 背景移除服务(The object detection / background removal service)

目前,显著性检测和背景移除,是委托给一个外部服务来完成。

如果直接在移动应用中使用类似DeepLap这样的技术会简单很多。但这还没有在这个repo中实现。

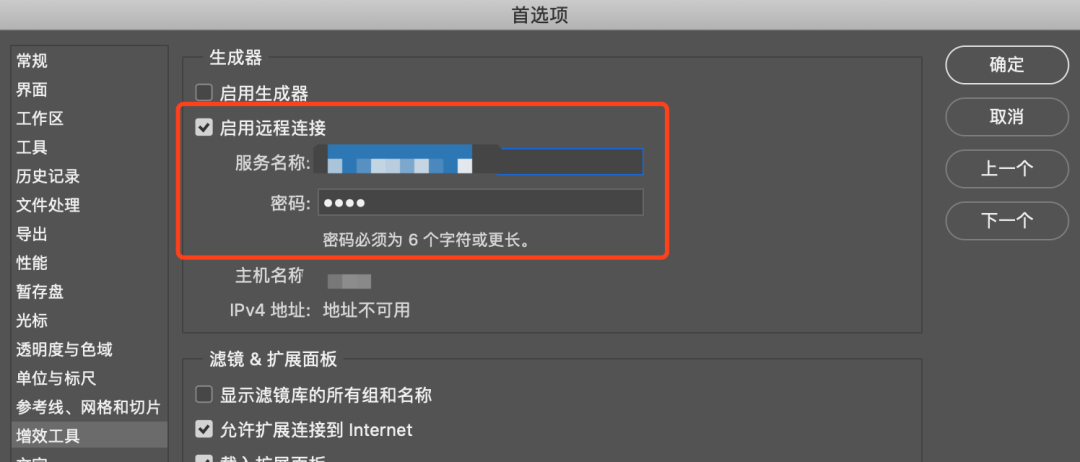

第一步:配置Photoshop

在Photoshop软件首选项(Preferences)中,找到增效工具(Plug-ins)。

点击启用远程连接(Remote Connection),并设置密码。

这里需要确保一点,PS文档中的设置要与server/src/ps.py中的设置一致,否则只会粘贴一个空层。

此外,文档需要一些背景,如果只是白色背景,SIFT可能没有足够能力来做一个正确的匹配。

第二步:设置外部显著性目标检测服务

如上所述,目前,必须使用BASNet-HTTP封装器(需要CUDA GPU)作为外部HTTP服务,部署BASNet模型。

将需要部署的服务URL来配置本地服务器。如果在本地服务的同一台计算机上运行BASNet,请确保配置不同的端口。

第三步:配置并运行本地服务器

这一步的详细文档,在GitHub项目中的/server文件夹中,包含“安装”和“运行”两个步骤。

安装代码如下:

virtualenv -p python3.7 venvsource venv/bin/activatepip install -r requirements.txt

运行代码如下:

python src/main.py \—basnet_service_ip=”http://X.X.X.X“ \—basnet_service_host=”basnet-http.default.example.com” \—photoshop_password 123456

其中,BASNET_SERVICE_HOST是可选的,只有在使用Knative / Cloud Run等入口网关在平台上部署服务时才需要。

以及,用Photoshop远程连接密码替换123456。

第四步:配置并运行移动App

安装代码如下:

npm install

然后更新component/Server.tsx中的IP地址,使其指向运行本地服务器的计算机IP:

3: const URL = “http://192.168.1.29:8080“;

运行代码如下:

npm start

OK!开启“复制粘贴”新世界,就是这么简单!

但如果你希望“知其然更知其所以然”,别眨眼,接着往下看。

如何做到隔空「复制粘贴」?

这个神奇的AR黑科技背后的主要技术,刚开始采用的是一个叫做BASNet的显著目标检测方法。

这篇研究入围了CVPR 2019,而且论文一作还是位华人小哥哥——秦雪彬,已经于今年2月在加拿大阿尔伯塔大学拿到了博士学位,硕士就读于北京大学。

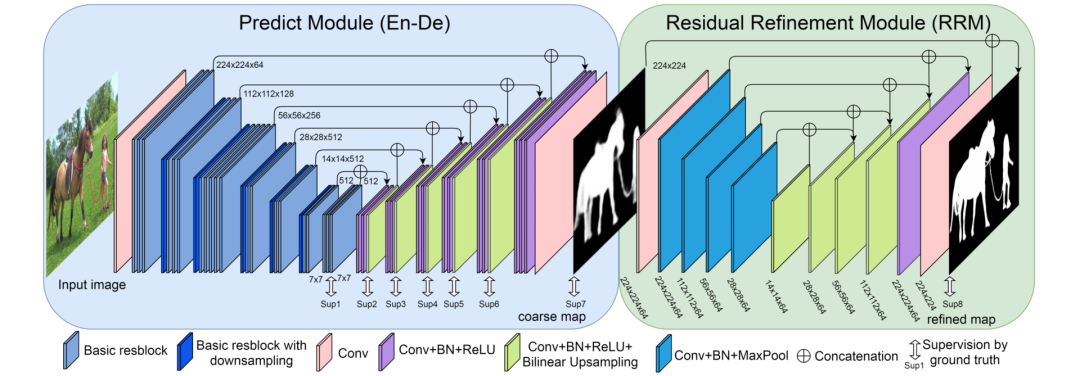

BASNet的核心框架如下图所示,主要由2个模块组成:

第一个模块是预测模块,这是一个类似于U-Net的密集监督的Encoder-Decoder网络,主要功能是从输入图像中学习预测saliency map。

第二个模块是多尺度残差细化模块(RRM),主要功能是通过学习残差来细化预测模块得到的Saliency map,与groun-truth之间的残差,从而细化出预测模块的Saliency map。

而最近,这位设计师小哥哥在此基础上,针对背景移除任务,采用了更新的方法。

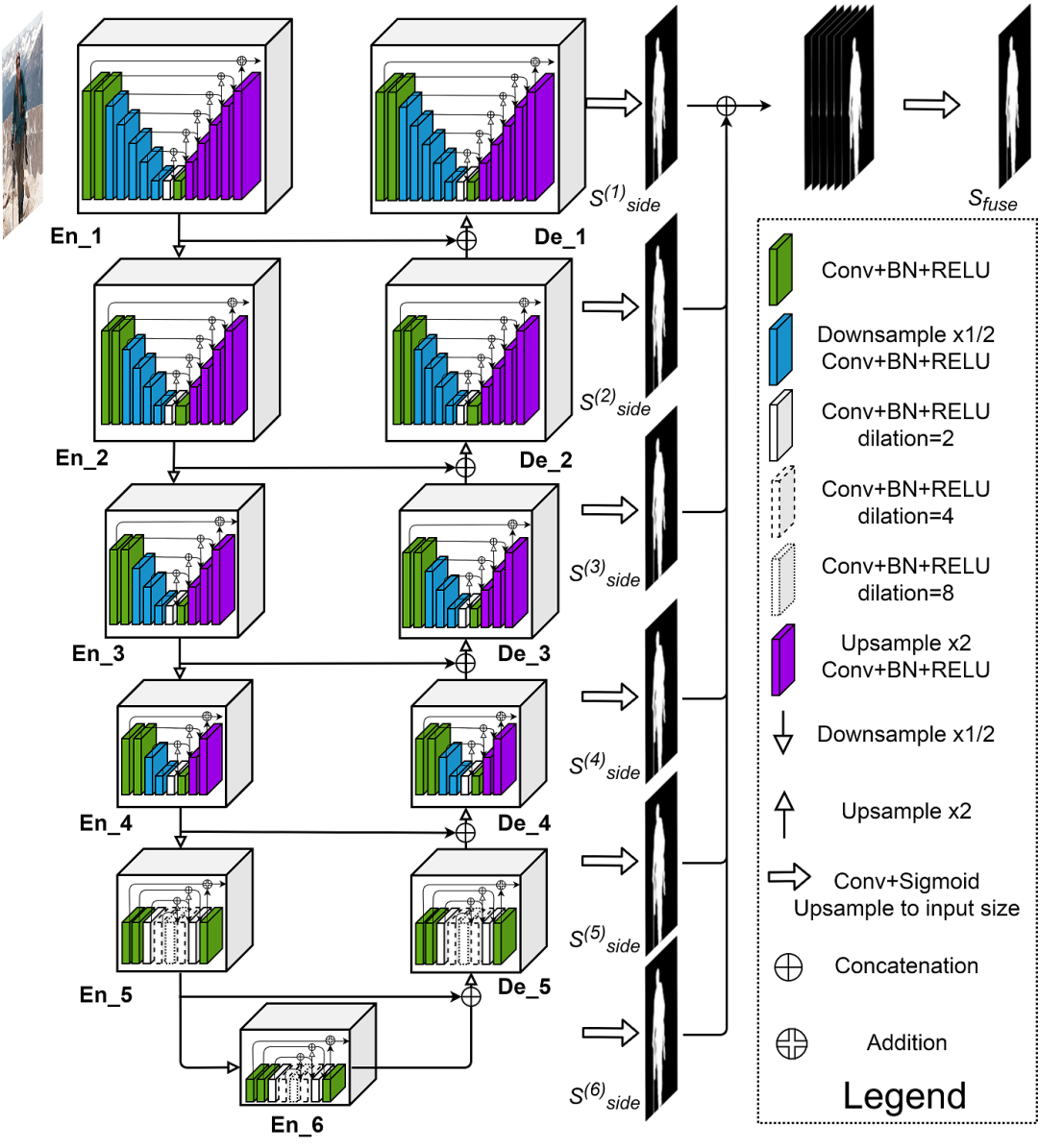

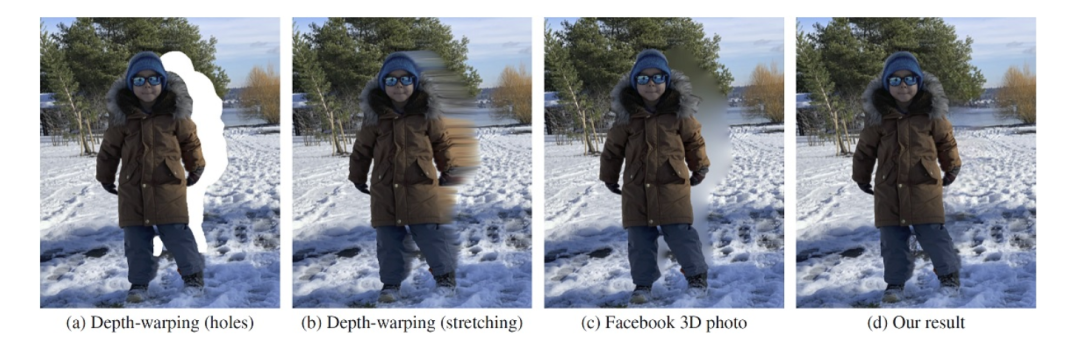

同样是来自秦雪彬团队,被Pattern Recognition 2020接收,这个方法叫做U2-Net,其框架如下图所示:

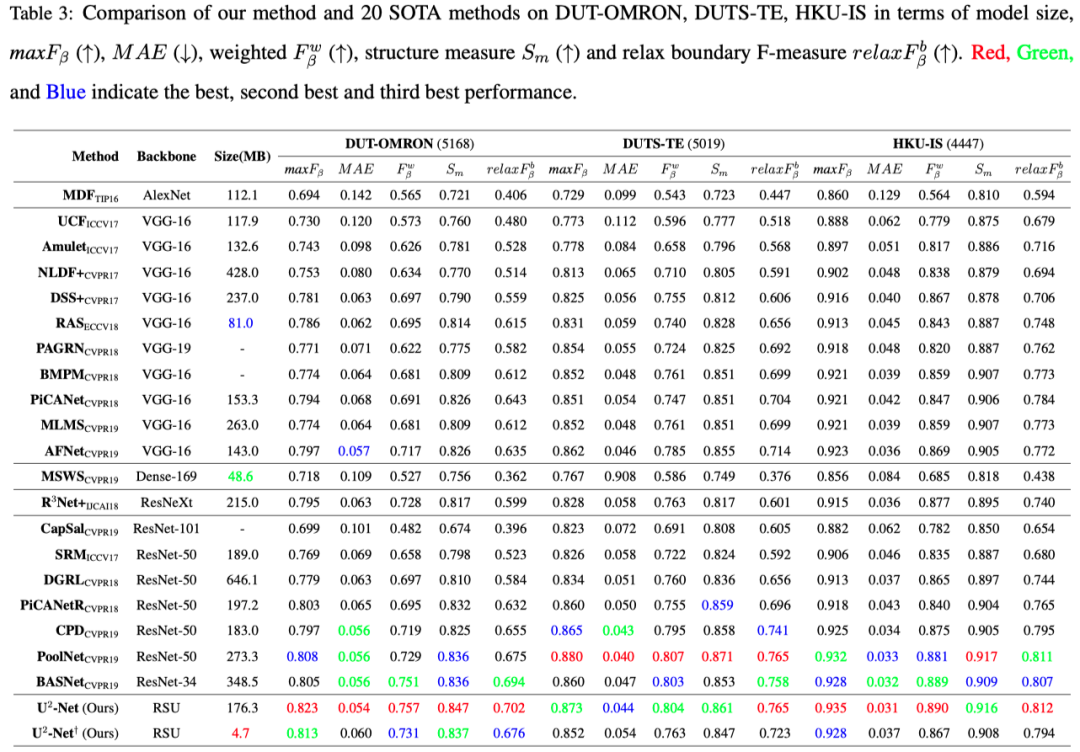

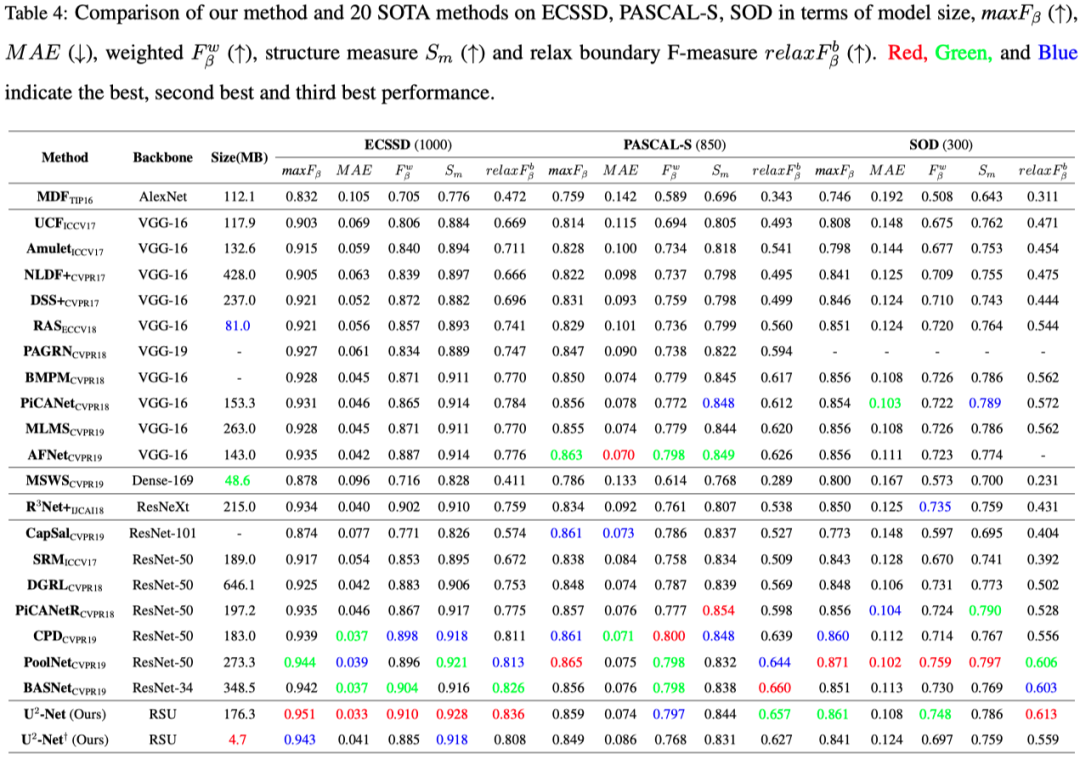

还与其它20个SOTA方法分别做了定量和定性比较实验,在结果上都取得了不错的结果。

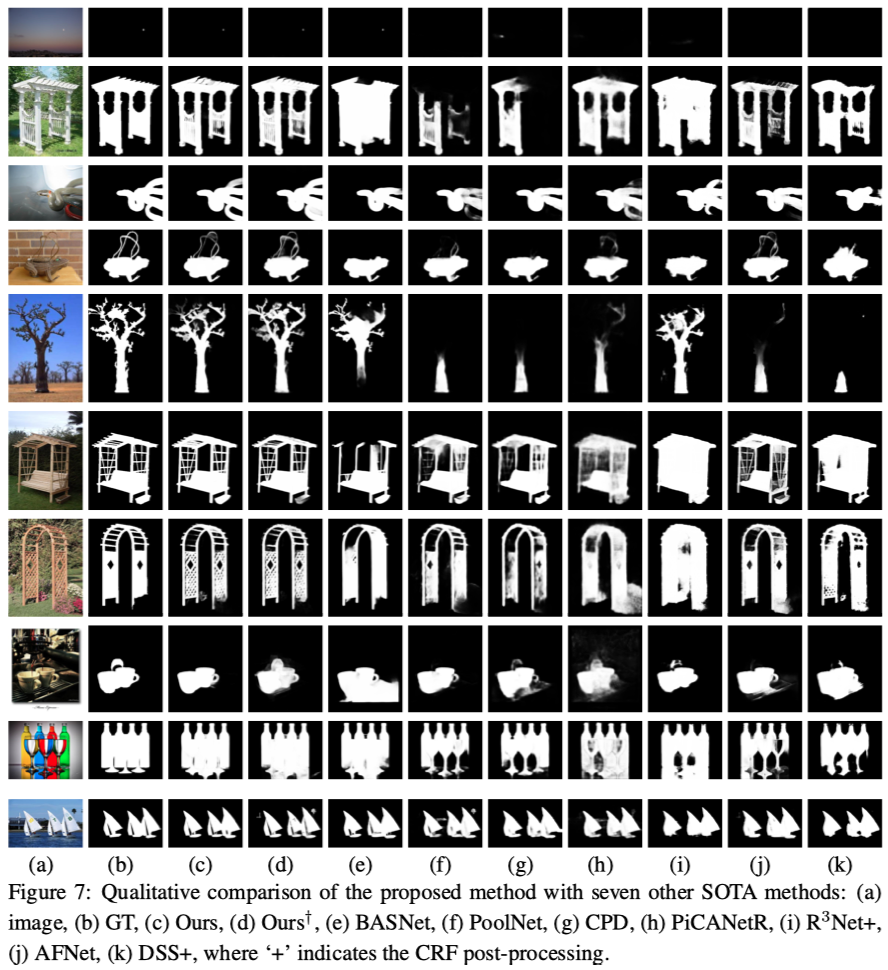

在下面的定性实验中,也可以比较明显的看到,该方法所提取出来的目标,更加细粒度和精确。

那么,北大校友的新方法,又是如何被法国设计师Cyril Diagne搞成黑科技应用的?

兼职写代码的法国设计师

原因无他,Cyril Diagne就是这样一个懂程序、搞设计,关注前沿研究进展的艺术家呀。

如果你关注他的社交动态,也都是天马行空的。

是那种从“诗词歌赋”到“人生哲学”,从“服装设计”到AR黑科技的妙人。

Cyril Diagne,现居法国巴黎,除了设计师,程序员,还是洛桑艺术州立大学(ECAL)媒体于交互设计系的教授及主管。

2008年从巴黎Les Gobelins学校毕业以后,跟5位同学创立了艺术机构,致力于实现科技与艺术之间的创意交互,也奠定了他以后的艺术生涯,注定与科技密不可分。

2015年起,Cyril加入了谷歌文化驻巴黎的实验室。

与此同时,他还不断的在Gitbub上分享他的新成果。此前,他就曾在Github上发布了一些实用的小工具。

比如,一个可在Instagram页面的照片上添加3D效果的chrome扩展程序。

在Web浏览器上直接用AR涂鸦你的脸。

输入图像转3D照片。

总之,想法多、经历丰富,还懂技术和审美……

所以现在搞出AR复制这样的奇妙应用,打开一扇新大门,也让一众网友服服气气。

也算是把北大校友小哥的牛X研究,推到了更牛X的产品应用入口。

虽然还只是牛刀小试,但前景却妥妥无限可能。

你觉得这项黑科技,还能怎么用?怎么玩?