人工智能革命揭秘上篇(上)

编者按:滚石杂志近日刊出了有关人工智能的特别报告,报告分上下两篇,目前已推出了上篇。作者Jeff Goodell访谈了从事人工智能(AI)研究的各方面专家,在上篇中总结人工智能取得的进展以及它对人类的意味;在下篇则重点探索AI对无人车以及未来战争的影响。我们编译出来供大家参考,由于篇幅较长,上篇会分上下两部分刊出。此为上篇的上半部分。

我们即将创造出一种新的生命形式,这个事件不仅是进化取得突破的标志,也有可能威胁到人类这个物种的生存。

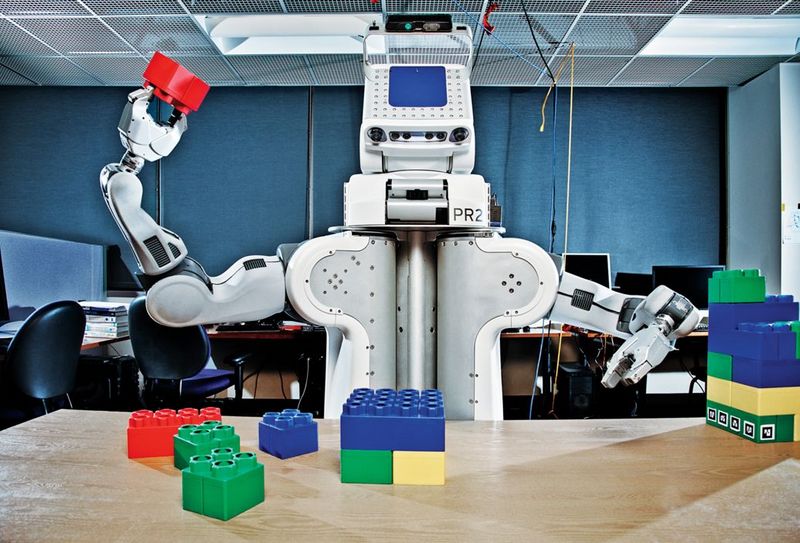

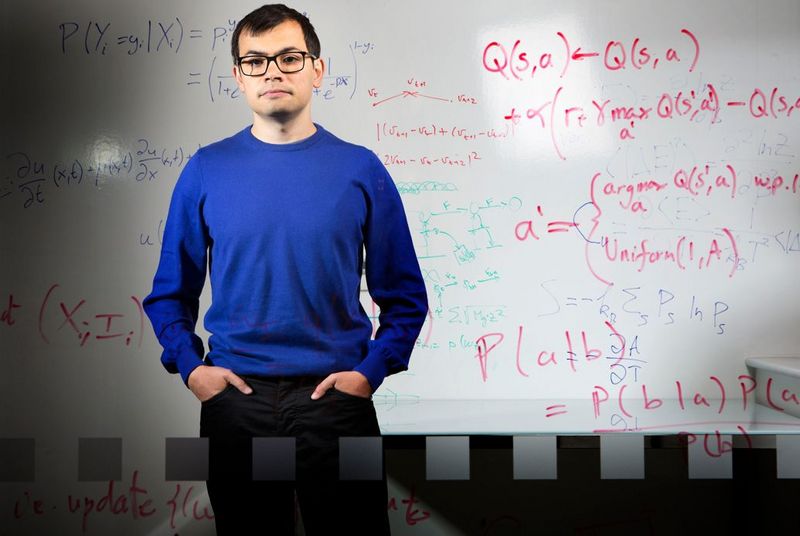

“欢迎光临机器人幼儿园,” Pieter Abbeel 一边说着,一边打开Robot Learning Lab的大门。位于加州大学伯克利分校北边一栋崭新建筑7楼的这座实验室实际上挺乱的:自行车就往墙边靠着,杂乱无章的小隔间里面呆着十几个研究生,白板上写着一般人看不懂的公式。38岁的Abbeel 是个身形瘦长的家伙,他下身穿一条牛仔裤,上面是一件宽松的T恤。2000年,他从比利时来到美国,在斯坦福攻读计算机博士。现在,在理解教会机器人智能思考所面临的挑战方面,他是全世界最重要的专家之一。但是首先,他得教会它们“思考”。“这就是为什么我们把这儿叫做幼儿园,”他开玩笑道。他把我介绍给Brett ,这个6英尺高的人形机器人是曾经著名现已破产的硅谷机器人制造商Willow Garage的产品。几年前实验室把Brett弄了过来用作实验。Brett的意思是“用来干完沉闷任务的伯克利机器人(Berkeley robot for the elimination of tedious tasks)”,这个外表友善的创造物头扁扁的,用摄像头充当的眼睛隔得远远的,身材矮矮胖胖,跟人一样它也有手有脚,握爪就是它的手,轮子就是它的脚。现在Brett已经下班,站在实验室中央,它身旁是另一个还没上电的神秘安详的机器人。附近的地板上有一箱玩具,里面有木锤、塑料玩具飞机、还有一堆乐高积木,这是Abbeel和他的学生对Brett的教学道具。不过Brett只是实验室众多机器人当中的一员而已。在另一个隔间,一张椅子背面的吊带上悬着一个18英寸高的机器人。在地下室下面还有一个工业机器人,它每天都要在一个相当于机器人沙盒的东西里面玩几个小时,为的只是想看看它能教自己什么东西。街对面的另一间实验室里,一个手术机器人正在学习如何缝合人的肉体,与此同时,一位研究生正在教无人机如何聪明地躲开物体。“我们不希望无人机撞到东西从天上掉下来,”Abbeel说:“所以我们正在教它们学会看东西。”

一直以来,可编程工业机器人执行的都是特定任务:移动机械臂到左边6英尺,抓起模块,然后转到右边,把模块插进PC印刷电路版。然后每小时重复这个动作300次。这些机械动作的机器在聪明程度上跟除草机无异。不过最近几年,机器学习(能够粗略模仿人类大脑并且让机器自学东西的算法)的突破让机器识别语音和视觉模式的能力得到了显著提升。Abbeel的目标是培养机器人具备一般智力—一种理解世界的办法,从而让机器人可以自主学习完成任务。他还有很长一段路要走。“机器人甚至还没有2岁小孩的学习能力,”他说。比方说Brett已经学会了做一些简单任务,像打绳结或叠衣服。但是一些人类很容易就能完成的事情,如认出桌上揉成一团的织物实际上是毛巾,对于机器人来说却特别困难,这部分是因为机器人缺乏常识,之前没有过叠毛巾的经验记忆,最重要的是,没有毛巾的概念。它看到的只是一团颜色。

为了规避这一问题,在一盒儿童心理学磁带的启发下,Abbeel创造了一种通过不断调整方法来完成任务的自学法。现在,当Brett整理衣物时,它也在做类似的事情:它会用抓手拿起毛巾,试着感觉一下它的形状,试试看怎么去折叠它。看起来很原始是吧,的确是。但你再想想:机器人这可是在学叠毛巾啊。

这一切科学怪人式的东西看起来有点令人毛骨悚然。智能机器能够执行的任务的复杂性正在以指数的速度增长。这最终会带我们去向何方?如果机器人自己能学会叠毛巾,是不是有朝一日也能做饭、做手术甚至发动战争?人工智能也许能够很好地帮助解决人类面临的最复杂问题,如治疗癌症,治理气候变化等,但在近期内它可能也会插手监视、侵犯隐私,不知疲倦地进行电话营销。除此以外,还有一个更大的问题正在显现:有朝一日机器会不会替自己着想?会不会对问题进行理性分析?甚至表现出情感?没人知道答案。智能机器的崛起跟任何其他技术革命都不一样,因为它最终危及的是人性的问题—我们有可能创造即将创造出一种新的生命形式,这种生命形式不仅是进化的突破,也可能会威胁到我们作为物种的生存。

人形机器人Brett可以自学造东西和对物体分类。

无论结局怎样,革命已经开始。去年夏天,伯克利的团队把一套短期记忆系统植入了一个仿真机器人里面。参与该项目的计算机科学家Sergey Levine说他们注意到了“一件奇怪的事情”。为了测试机器人的记忆程序,他们向机器人发出一项指令,要求它把一颗钉放到一左一右两个洞的其中之一。出于控制的考虑,他们再度在移除记忆程序的情况下又试验了一次—令他们感到惊讶的是,机器人仍然知道把钉放进正确的洞口。在没有存储的情况下它是如何记得钉子应该放到哪里的呢?“最终我们意识到,只要机器人接收了指令,它就会旋转机械臂到正确的洞口。”然后,在命令消失之后,它会看自己的身体扭向什么位置才确定钉子应该放在哪个洞里面。也就是说,机器人自己实际上已经找到了正确执行命令的办法。“这非常令人吃惊,”Levine说:“也让人不安。”

Abbeel带我去到他的办公室,这是一间没有窗户的小隔间。在办公室里,他跟我谈到了DeepMind(2014年被Google以约4亿美元收购的AI初创企业)最近取得的一项突破。几年前,因为教会计算机玩太空入侵者之类的雅达利视频游戏并且玩得比人类还溜,DeepMind已经震惊了大家一把。不过更令人震惊的是,DeepMind是在没有在程序中告诉计算机游戏规则的情况下做到的。。这不像深蓝在国际象棋比赛中击败人类那样,游戏规则是在程序里面写好的。计算机只知道一点:目标是拿高分。计算机采用的是强化学习法来做到这一点,这就好比训练狗,不管它用什么办法,只要它做到了你就表扬一声“好狗”一样,计算机就可以通过这种机制来探索游戏,在反馈中自己学会规则。在几个小时之内,计算机就掌握了超人的技巧。这是AI的一项重大突破—计算机第一次自己“学会”了一项复杂技能。

Abbeel的实验室的研究人员对这项突破感到着迷,他们决定用自己写的类似强化学习算法来做实验,试图帮助机器人学习游泳、学习单脚跳以及走路。或者玩视频游戏怎样?令他们惊讶的是,这个所谓的TRPO(Trust Region Policy Optimization,信任区域策略优化)算法实现的结果几乎跟DeepMind的算法一样好。换句话说,TRPO展现出了用一般方法学习的能力。“我们发现TRPO不仅可以教机器人走路,”Abbeel说:“还可以在视频游戏中击败人类。”

Abbeel调出了一个有关一个机器人模拟器的视频。视频开头可以看到一个机器人摔倒在黑白相间的地板上。“记住,这个算法跟学视频游戏的是一样的,”他说。机器人被布置了3个目标:有多远走多远,不要踩到自己的脚,以及躯干要高于一定高度。“它不知道走路是什么意思,”Abbeel说:“也不知道自己有手有脚。它只知道自己的目标。然后想办法实现目标。”

Abbeel按下一个按钮,模拟开始工作。机器人笨重地摔到地上,不知道自己在干什么。“原则上,它应该能确定自己要走还是跳,”Abbeel说。但是算法是通过实时“了解”到只要把自己的腿抬起来,它就能推动自己向前走来确定的。这让机器人可以分析自己上一次的表现,解码出哪一种动作的表现更好,然后在未来相应改变行为。很快机器人就开始蹒跚而行,东倒西歪像喝醉酒一样。它会突然往前扑倒,爬起来,走了几步,然后又倒了。但是慢慢地它的表现开始提高,学会了跌跌撞撞地朝着目标跑过去了。你几乎能感觉到它的信心在增加,抬腿的速度快得就像一名跑锋(running back)一样。机器人不知道自己在跑,因为程序没有进行设置。但现在它已经在跑了。它自己学会了复杂的平衡和肢体控制这些物理学的知识。这已经不仅仅是令人吃惊了,简直就是魔术。就好像是在短短40秒的时间内目睹一条鱼变成了人一样。

“机器人移动和开始走路的方式让它看起来就像是活的一样,”我说。

Abbeel笑了:“差不多吧。”

尽管书本和电影里面有人工智能的各种渲染,但这个东西可不是悬浮在某处蓝色液体箱的一个合成大脑。人工智能是算法—一个数学方程式,它告诉计算机执行什么功能(通俗点你可以把它理解为机器的食谱;更深入的话题可参见寻找生命的基础算法 )。21世纪的算法就像是19世纪的煤矿:是我们的经济引擎,是现代生活的燃料。没有算法,你的电话无法工作,也不会有Facebook、Google、Amazon。算法规划航班然后引导飞机飞行,算法帮医生诊断疾病。“如果每个算法突然停止工作,我们所熟知的世界就要终结,”机器学习的流行读物《主算法》的作者Pedro Domingos(参见有没有主宰世界的主算法 )写道。在AI的世界里,圣杯就是发现能够让机器理解世界的那个算法,这就好比是能够让物理学家解释宇宙运作机制的标准模型,只不过前者是数字世界的。

在DeepMind伦敦办公室的Google 的智能设计师Demis Hassabis ,他还一位是神经科学家、计算机游戏设计师以及世界级的游戏玩家。

数学算法已经有几千年的历史,是现代计算的基础。输入数据,计算机处理,然后算法吐出结果。但是现在科学家已经开发出能够逆转这个过程的算法,也就是让计算机写自己的算法。比方说你想让直升机倒着飞:你会写个算法告诉计算机有关直升机控制方面(输入数据)的信息,然后你告诉它你想让直升机怎么飞,飞行角度如何(结果),Bingo!计算机就会倒腾出自己的算法,然后告诉直升机怎么做。这个过程就叫机器学习,它是AI想法的核心:如果机器能够教自己让直升机倒着飞的话,那它也应该会自学其他事情,比如如何在Tinder上找到爱人,或者在你对着iPhone说话时认出你的声音,或者将来设计出一个创造终结者的天网出来。DeepMind 联合创始人Demis Hassabis 已经说了:“人工智能是让机器变聪明的科学。”

当然,实际上我们已经被智能机器包围了。你在用Google Maps的时候,算法给你画了一条最快捷的路线,并且根据实时数据计算出交通延误并对交通状况作出预测性分析。当你对着Google Voice说话时,它能认出你的声音是基于神经网络这种机器学习算法,它让计算机把你的话变成声音片段,然后跟别的片段进行比较,再理解你的问题。Facebook通过图像识别程序扫描数十亿图片,将斩首视频、JB图片等有害内容拒之门外。

智能机器正在加速,可它要去向何方呢?地球的生命从诞生到实现更高智能花了30亿年的时间。相比之下,计算机大概只用60年就从一大块硅片变成了能够开车穿越美国或者在人群中认出一张脸的机器。每过去一周,就会有新的突破被宣布出来:今年1月,DeepMind披露自己已经开发出一种算法,这种算法击败了欧洲的围棋冠军(该算法叫做AlphaGo,从3月9号开始,它将与韩国的顶尖围棋选手李世石进行一场5番棋大战)。当然,它的快速演进还在人类的掌控当中,但你很难不去想我们是不是已经到达智能机器演进的某个拐点了。我们是不是即将目睹一个新物种的诞生?机器还要多久就会变得比人还要聪明呢?

Elon Musk警告人类要注意AI的危险

Google的未来学家Ray Kurzweil提出了后来风行的“奇点”论,奇点说的是硅基机器变得比碳基机器(人类)更聪明的时刻,到那个时候,进化的天平将会向前者倾斜。“未来我们会对云展开大量思考,”他在几年前的一场技术会议上如此说道。他甚至还预测了奇点到来的确切时间:2045年。在最近一场会议上的即席发言时,Tesla和SpaceX的创始人Elon Musk把AI的发展称为是“对恶魔的召唤”。尽管随后他告诉我说自己的说法有点过头,但他又说:“智能机器的崛起向我们提出了一个严重的问题,即我们需要考虑,作为人类我们是谁?我们希望建设一个怎样的未来?”正如他指出那样,我们现在已经严重依赖机器了:“我们已经是赛博格(cyborg)了。不信你把手机关了看看—你就会知道幻肢综合症是什么样子的。”

这并不是说超智机器要变得超级邪恶才会构成威胁。“AI的真正风险不在于它的恶意,而在于它的能力,”物理学家霍金最近指出:“超智AI极其擅长实现自己的目标,如果它的目标跟我们的不一致的话,我们就有麻烦了。你可能并不是邪恶的蚂蚁仇恨者,不会出于恶意踩死蚂蚁,但如果由你来负责一个水电绿色能源项目,然后需要淹没一个蚁窝所在的区域时,对于蚂蚁来说情况就太糟糕了。我们不要让人类落到那些蚂蚁的境地。”

尽管有了更智能的算法、有了能力更强的机器人,但超智机器的未来仍然更像是科幻而不是科学。Facebook AI Research的负责人Yann LeCun说,现在“AI的智能水平还远不如一只老鼠。”是的,IBM经年累月的编程和白花花的银子砸出了Watson,2011年这台机器在智力竞赛中击败了最聪明的人类选手,现在,它是该公司“认知计算”行动的基础。一秒钟它可以阅读完8亿页的信息,消化掉维基百科的一整个语料库,更不用说几十年的法律和医学杂志。但是它不能教你如何骑自行车,因为它的智能是狭隘的—它对世界如何运作一无所知。西雅图Allen Institute for Artificial Intelligence的Aristo是最复杂的AI程序之一,但是对于“人呼吸空气”这样的句子却是一头雾水。因为要想理解这个句子,你需要一些常识—但机器没有常识。哪怕常识可以通过语言定义,程序也不知道呼吸空气是否就是人活下来之所需;也不知道人是一分钟呼吸一次还是一辈子只用呼吸一次。一些给人留下深刻印象的功能,如能让用户用不同语言实时对话的Skype Translator(目前还是预览版),也还有很长的路要走。在跟意大利的一个人对话时,我对天气的评论被翻译成了对圣经的解释。

“Jeopardy!”智力竞赛冠军Ken Jennings和Brad Rutter无助地看着IBM超级计算机Watson攻城拔寨

当然,这并不是说智能机器的崛起只是一个虚幻,也不是说天网不会在我们难以想象的数据点集合中突然出现。自动武器,比如可以自行根据人脸识别技术等数据执行任务的无人机杀手(参见无人机百年史话)就是真正的威胁。但它们不是不会对人类这个物种的生存造成威胁。朝鲜黑客突然之间创造出一种让金三有能力对世界发动终结者式攻击的新算法的可能性也很低。在这种语境下,AI不像iPhone,写出一个新app你的活就干完了。这更像是自己来造互联网—这只能慢慢完成,要通过日积月累的点滴进展。百度首席科学家吴恩达最近告诉我说:“担心杀手机器人就像是在担心火星出现人口过剩一样—我们还有很多时间去解决麻烦。”

实际上,对杀手机器人夸大其词的问题在于它掩盖了我们所面临的智能机器崛起的真正风险—工人因为被机器人替代而失业,战争中使用自动武器的增加,还有这个简单的事实,我们越是依赖机器,有东西出问题时我们的风险就越高。我们生活在这样一个世界的问题在于人际关系的疏远—我们跟机器的对话比跟人聊得更多(可以看看电影《her》),在于艺术变成了一种和谐的算法输出(参见机器学习艺术,Facebook 的深度学习系统可造出以假乱真的图像)。AI时代还会对隐私造成影响深远的挑战,不仅仅有智能无人机在天上监视你,企业也会跟踪你的一举一动好卖东西给你。正如伦理道德研究院的CTO Marcelo Rinesi总结那样:“未来不是机器人一只脚永远踩在人脸上(注:原句出自奥威尔的《1984》:如果你要设想一幅未来的图景,就想象一只脚踩在一张人脸上好了——永远如此)。而是一个你看到的一切东西里面都有一个小小的电话推销员的世界,一个知道有关你的一切,永远不会停止卖东西给你的世界。”

这还掩盖了与机器深层次结盟所带来的好处。大多数的研究人员,像DeepMind的Demis Hassabis就认为,如果我们赋予机器智能的话,它们就能够帮助我们解决疾病和医疗保健这样的大问题,也能帮助科学家攻克气候变化和物理学方面的大难题。微软的Eric Horvitz对AI的展望甚至更加宏伟:“对于人类来说,一个大的问题是我们的经验是不是可以计算的?如果是的话,对我们思维方式的更好理解,能不能告诉我们一些有关我们作为地球生命是什么样的新发现?有了这些自我认知之后,我们又能够做些什么呢?”

人工智能革命揭秘上篇(下)

人工智能革命揭秘下篇(上)

人工智能革命揭秘下篇(下)