亚马逊AI被曝性别歧视?人事部门却在悄悄给女性“开绿灯”

编者按:本文来自“硅谷密探”(ID:guigudiyixian),作者:李鲁,36氪经授权转载。

你知道Google每年收到多少求职者的简历吗?据JobVine统计,超过100万份。

其他大公司也无外乎于此,而这毫无疑问对于HR来讲是巨大的负担。那有没有可能用AI解决这个问题呢?

在过去几年中,AI行业发展迅速。据Crunchbase统计,截止2018年,光是在硅谷研究或应用AI的公司就超过1400家。尽管做AI的公司多,目前行业里的应用场景主要还是集中在教育、医疗、无人驾驶等方面。

作为科技巨头,Amazon正在尝试拓展新的应用场景——用AI给简历打分,帮HR分担压力。然而这项应用却在最近被爆出一个巨大的问题。

AI偏爱男性应聘者?

Amazon的AI程序通过检索简历中的关键词,评估应聘者的能力以及和申请职位的匹配度,再综合打分,给HR推荐理想的人选。

但是这个程序在应用一年后,却被Amazon高层宣布关停。这是为什么呢?

原来AI程序在打分时,给男性应聘者的简历打分明显比给女性打分高,也就是说AI更偏爱男性。Amazon的工程师们之后针对这一现象展开调查,发现原来AI程序在分析简历时,会识别暗示应聘者性别的关键词,比如“女子学校”、“女子篮球队”等,通过这些关键词推断应聘者的性别,并降低女性应聘者简历的评分。

但为什么AI要针对女性呢?大家都是来找工作的,这不是明摆着性别歧视吗?这个问题的答案,隐藏在AI深度学习的样本里。

Amazon的工程师经过进一步的调查发现,原来AI程序偏爱男性应聘者,是因为AI深度学习的样本来自于Amazon公司过去10年内收到的所有简历。而这些简历中,原本男性申请者就偏多,并且最终录取的员工中也是男性居多。因此AI在深度学习的过程中形成了一种认知,那就是男性应聘者比女性更优秀。基于这种认知,AI给男性应聘者的简历评分更高。

之后Amazon的工程师针对这个现象,修改了AI程序的代码和算法,让AI程序不再通过检索关键词来推断应聘者性别。但这种方法没有实际解决问题。AI已经通过深度学习形成了“男性应聘者比女性更优秀”的认知,所以即便不检索关键词,工程师也不能保证AI不会通过其他方法推断性别。

正因为如此,在AI程序被投入使用一年后,Amazon高层最终宣布关停项目。

可能的解决方案

虽然Amazon关停了项目,但AI偏爱男性应聘者,是否真的无法通过优化程序解决呢?如果采用不同的样本,又是否能改善这个问题呢?

为此小探就可能的解决方案,采访了一位不愿透露姓名的业内人士。

听小探把整个事件徐徐道来之后,这位人士提出了一个方案:首先设置两套AI程序,在深度学习的过程中,男性和女性的样本分开学习,然后在评分过程中,先让AI把简历按性别分为两组,再用针对男性的AI程序给男性打分,用针对女性的给女性打分,这样就能最大程度保证公平。

小探听完之后不由得感叹业内人士的专业性,谈笑间便提出了一个具体的解决方案,似乎让问题迎刃而解。然而,如果问题这么简单就能解决,为什么Amazon的工程师们还拿它毫无办法,以至于高层最终不得已关停了项目呢?小探怀着将信将疑的态度,又采访了一位Google的工程师。

果不其然,这位工程师对“分开学习、分开评分“的方法产生了质疑:如果涉及两个程序,分别深度学习两个性别的样本,那么针对女性的AI程序因为样本太少,学习不到需要的特性,从而在评分时很可能产生新的问题。

至于通过修改算法,能否让AI评分变得公平,这位工程师的答案是:很难。他向小探解释道,现在深度学习一个很大的问题就是,模型极其难以解释——当AI做出一个判断时,工程师很难分析出它是怎么作出这个判断的。所以,也许Amazon的AI缺乏“可解释性”。

“可解释性”,简单来说,就是当AI作出一个判断,工程师能知道是AI神经网络的哪些部分,根据样本中的哪些线索,得出了那个判断。而Amazon最终选择关停项目,很有可能是由于AI缺乏“可解释性”,造成工程师不知道该修改AI神经网络中的哪些部分,导致问题一直无法被实际解决。因此这位工程师最后给出的论断是,“工程上来讲,想修复这个问题很难”。

不过,并不是所有工程师都对此不看好。小探采访了一位微软的工程师,他在电话中自信地表示:技术层面上,一定能实现公平对待男性和女性应聘者。

然而紧接着,他便反问小探:“但你是想反映公平,还是想反映真实?”

小探不禁陷入沉思。难道我们追求的公平——让男性女性有同样的机会就职——是不真实的吗?

AI印证了现状,HR却想改变现状

Amazon的AI偏爱男性应聘者,不仅暴露了Amazon公司内男多女少的问题,还反映了整个科技行业内男女比例失衡的现象。

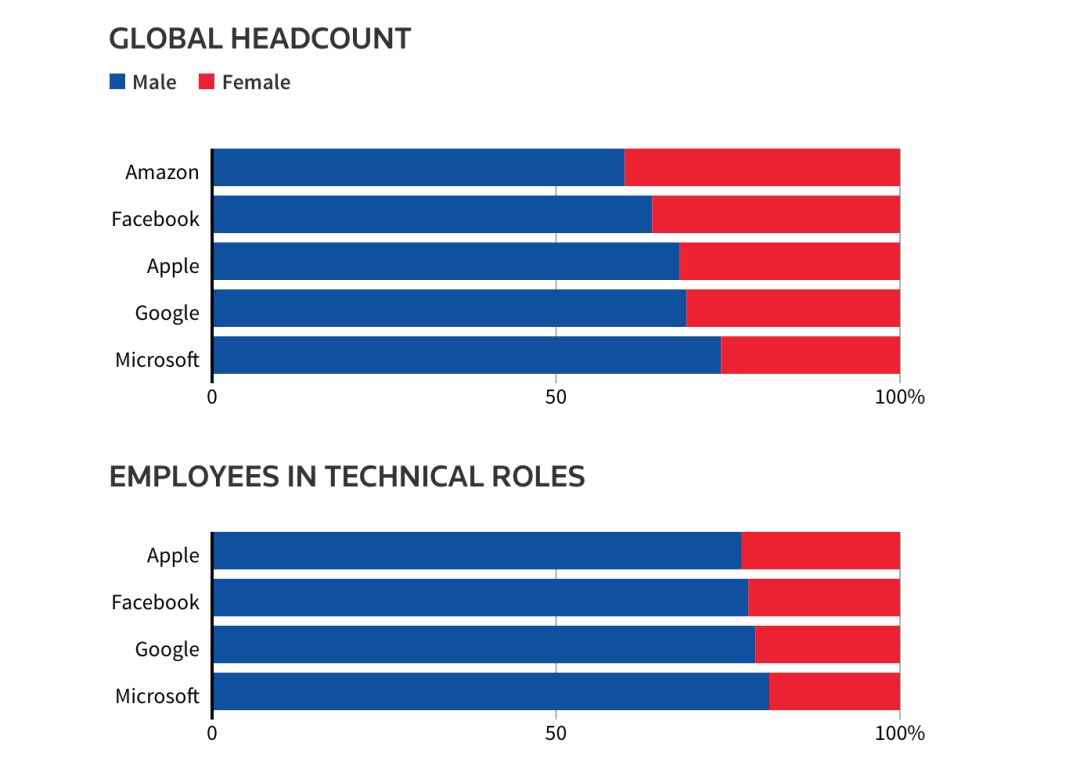

据路透社统计,Amazon、Facebook、Apple、Google、Microsoft五家科技巨头的员工中男性占比分别为60%、64%、68%、69%、74%。而这五家公司中技术类职位男性占比甚至更高,最高的Microsoft占比达到81%。

各大科技公司员工男女比例:蓝色为男性,红色为女性

因此Amazon的AI并不是针对谁,而只是基于样本映射出了现实——男多女少,是目前整个科技行业面临的痛点。

为什么这是痛点呢?首先,对于体量庞大的科技公司而言,男多女少意味着公司内部人员组成单一。要知道创新是科技公司的命脉,而创新往往是通过不同思维的碰撞产生的。一旦公司人员组成过于单一,思维的碰撞就会减少,导致创新减少,切断了科技公司的命脉。

其次,过于明显的男女比例失衡,容易给公司招致“性别歧视”的骂名。因为对于“高大上”的科技行业,公众往往抱有一种美好的期望,认为在这个行业中一切都应该公平公正,因此一旦有一丝迹象表明了不公平现象的存在,比如男多女少的问题,公众便会把公司推向社会舆论的风口浪尖,让公司高层承担巨大压力。

出于诸如此类的种种担忧,科技公司近些年都在尝试解决男多女少的问题,而其中最简单粗暴的方法就是多招女员工。在招聘过程中,HR往往会给女性申请者“降低门槛”,比如在评估时酌情提高对她们的综合打分,或是在一男一女技能水平相当的候选人当中,选择那个女性申请者。

对此,小探特地浏览了许多Reddit上讨论招聘过程的帖子,并且询问了一位当过面试官的朋友,最终得到了非常统一的答案:虽然面试官只给申请者评分,而最终决定权在委员会手里,但是在同一个面试官给出相同评分的男性和女性申请者中,女性通常会得到委员会的更多考虑。

那么,为何即使科技公司如此愿意招女性,科技行业中男多女少的问题还是一直存在呢?根本原因在于:理工科的女性本来就少。

据美国国家教育统计中心的数据显示,2015年美国大学计算机专业的毕业生中,女性只占18%。虽然这不是最新数据,但也足以说明问题——理工科的女性总数就很少,而科技公司中大多数职位都与技术相关,即使公司愿意“开绿灯”,仍然很难提高女性在科技公司中的比例。

因此我们不难看出,AI的判断是科技行业中男多女少的现状的延续,HR人工的判断则是渴望改变现状的体现。然而目前的AI程序,只能通过样本学习过去的规律,但还无法理解人基于社会现状产生的某些需求。这或许才是Amazon高层决定关停项目的真实原因。

所谓“公平”就是一半男性一半女性?

“公平“这个话题,太过于辩证;公平与不公平的分界线,也很难定义。

对于目前科技行业内男多女少的现象,采访中一位女性UI设计师说过一句话,给小探留下了很深的印象。这位设计师说:“男多女少也许是真的,但这不是歧视的产物。”

就像本文之前所说的,造成科技行业中男多女少的根本原因,不是科技公司不愿意招女性,而是本来理工科的女性就少,因此难以在整个行业中呈现出“女性扛起半边天”的景象。

人类社会从古自今,都强调分工协作的重要性;工业时代来临后,分工协作更是大大提高了社会效率。不管出于任何原因,学习并从事技术相关工作的男性比女性多,是无可争辩的现实,就像学习并从事营销、传媒、艺术等领域工作的女性比男性多一样。因此,一半男性一半女性并不是真正的公平,因为这不符合社会的现状。

那么在这种现实背景下,强行增加科技行业中女性的比例,是否有些矫枉过正呢?在各方面技能相同的情况下,公司为了保证男女比例不失衡,有意选择女性,是否又是另一种不公平呢?

小探认为,相比起男女人数比例,也许同一个岗位上,男性和女性做同样多的工作,挣一样多的工资,这才是真正的公平。

所以,人都还没搞清楚什么是公平,就想用机器来达到公平,实属科技发展得“太着急”的表现。