【新智元导读】知道吗?你的每一次点击,背后都发生了一场「世界大战」。

看看这段澳洲课堂上老师播放的特朗普和蓬莱奥合唱《我爱你中国》的视频就知道,技术就是工具,它可以造假,也可能「失控」。

原视频:UFO上的书虫

技术虽然成就了互联网,但它也正在被利用生成新的隐患。

今年9月7日,中科大网络信息中心的老师们向全校师生发放4万封「免费送月饼」的钓鱼邮件,测试师生们的反诈骗能力。结果,3100余位学生、400余位教职工中招。

可以肯定的一点是,网络风险正在从黑客们专业的「网络攻击」扩展到普通人关心的方方面面,普通人已经难敌技术带来的假象和骗局。随着安全风险正在成为网络世界的头号隐患,我们的生活,也正在因为技术安全的博弈而发生着巨大的变化。

为了应对这些挑战,阿里巴巴、腾讯集团、蚂蚁集团、360等各大互联网公司大力发展安全科技。

一方面,这些实验室的安全专家在注重人工智能本身的技术安全性,大力发展可信AI;另一方面,他们在通过将人工智能技术与安全技术融合来实现安全防护,安全科技已经传统的系统安全升级为多元的安全技术体系。其中,以安全实验室为主体,这些互联网企业正在实现安全科技上的巨大突破。

例如,360的Vulcan Team、追影实验室、Sky-Go Team、0kee Team等,在网络犯罪研究、黑灰产打击、反网络诈骗、挖掘安全漏洞等方面都成绩斐然。

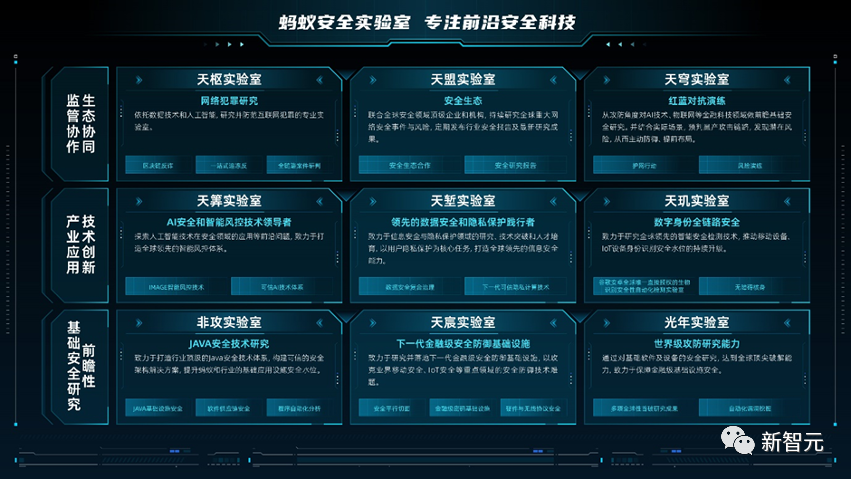

蚂蚁的9大安全实验室,聚焦智能风控、数字身份、数据安全隐私保护等领域的前沿安全技术,构建了「鲁棒性、可解释性、隐私保护、公平性」为核心特征的可信AI技术架构,在反诈反洗钱等方面取得重要成效。

人工智能发展至今,已经有60多年的历史了。

在以前,AI是靠知识驱动、数据驱动,而现在,行业走到了以安全可控为核心的阶段。

而人工智能技术与安全技术的融合,也代表了安全领域进入了一个新的阶段——可信AI。

自从谷歌人工智能围棋软件AlphaGo横扫人类世界冠军,标志着AI的无所不能。随着AI广泛落地到各个领域中,安全隐患也随之而来。

2015年2月,英国进行了首例机器人心瓣修复手术。期间,溅到摄像头上的血液,让机器人「瞎了眼」,一把戳穿了大动脉。最终,患者在术后一周去世。

2016年9月,一辆处于「定速」状态的特斯拉,因未能识别躲闪而撞上前车,造成驾驶员身亡。而这也被认为是国内首起特斯拉自动驾驶功能使用中发生的车祸致死案例。

随着类似的事件越来越多,人类对于人工智能产生了「信任危机」。

可以看到,虽然当前深度学习的算法准确率已经达到了99%,但是当它在现实中落地时,即使是1%的错误,也是我们无法承受的。当前基于神经网络的AI技术具有不可解释、鲁棒性差、过于依赖数据等通病。

IEEE在2017年12月提出了《人工智能的伦理设计准则》,紧接着澳洲、美国、新加坡等都提出了相关的政策、指南或白皮书;国内,何积丰院士于2017年11月香山科学会议上首次提出了「可信人工智能」的概念;在此之后,京东、蚂蚁、腾讯等互联网大厂企业纷纷入场「可信AI」。

「简单来说,『可信AI』包含四大基本原则:隐私保护、鲁棒性/稳定性、可解释性和公平性」,蚂蚁安全天筭实验室负责人王维强这样定义。

首先是公平性。AI的偏见是从何而来呢?我们训练AI,是通过「喂」给模型大量的真实数据,然而AI被训练后,却可能因为数据采集中的偏见,而不公平地对待人类。

比如亚马逊的机器学习专家曾发现,他们的招聘算法对包含「女性」一词的技术职位的简历进行了降级,并「惩罚」了两所全女性大学的毕业生。而该算法是根据亚马逊10年来的招聘数据进行的训练,其中技术岗位的人员大多为男性。没错,AI就是这样「打脸」了人类:你们的偏见无所不在。

其次是鲁棒性。现在的黑产有很多针对AI模型的攻击方式,比如中毒攻击、对抗攻击、后门攻击等。如果模型不够鲁棒,哪怕模型特别简单,都很快会被黑产打穿。曾有人测试过,在路牌上贴一张贴纸,自动驾驶汽车的AI就识别不出来了,这也会造成严重的后果。

像支付宝这样的互联网支付平台,每天都会受到上亿次的黑产攻击。如果速度比黑产慢,成千上万的支付宝用户资金安全就会受到威胁。这时,风控模型与算法鲁棒性就变得至关重要。

第三是可解释性。我们都知道,以深度学习为代表的机器学习算法,可以看成是一个端到端的黑箱。我们不理解AI为何会有这么高的性能,不明白AI是怎样做决策的。如果可解释性比较差,用户交互或者给监管解释时就会有比较大的挑战。

最后一个是隐私保护。隐私泄露的危害,我们在上文里已经看到了。显然,现在随着数据泄露导致的风险越来越大,我们需要仔细思考,如何在「数据保护」与「数据驱动的AI研究」中取得两全。

天筭实验室是蚂蚁安全实验室中专注于可信AI与智能风控研究的主力军。为了让AI算法更加安全可信,天筭实验室还研发了「蚁鉴」平台,并把这个能力开放了出来。这也成为可信AI这个领域,在今年里一个「大事」。

这是一个面向工业场景全数据类型的AI安全检测平台。它融入了博弈理论、逻辑推理、隐私计算,可以通过系统化、标准化、智能化检测提前发现模型的潜在漏洞,提升AI模型的风险识别和风险防御能力。

这样,通过一系列的测试,就可以确保模型上线之前,能够避免那些常见的攻击,从而提升模型的鲁棒性。未来,这个平台还将逐步增加AI可解释、公平、隐私的相关检测。

「如果我们能让人工智能在这四个方面的「可信」度量上都达到很高的共识水平,或许就有机会从根源上消除制约AI技术的弊端,使AI对人类来说更加值得信任」,王维强这样说。

这是一个相杀相爱的过程。面向未来更大规模的智能化,人类和AI的合作刚刚开始,人类和AI的对抗也刚刚开始。

而当可信AI遇上风控,各大安全实验室都在深耕以「鲁棒性、可解释性、隐私保护、公平性」这几个原则为核心特征的智能风控技术架构。

比如蚂蚁安全实验室,就把以可信AI为基础的IMAGE风控体系作为抵御数字时代风险的核心能力。

如今的我们,对于「电信诈骗」可谓是耳熟能详,而这有一个令人唏嘘的起因。

在2016年8月,18岁的山东女生徐玉玉遭遇电信诈骗被骗走了9900元学费,伤心过度,引发心脏骤停去世。这场悲剧,令社会对由来已久的电信诈骗的愤怒达到顶峰。

而2016年也成为标志性的一年,国内外多家专业机构的研究显示,电子支付平台的风险以2016年为分水岭。这一年,也认为是全社会防电信诈骗的元年。

在此之前,各家支付平台面临的风险挑战主要以直接盗取账户、盗取银行卡等为主,而在此之后利用信息网络、AI技术的电信网络诈骗、跨境赌博为代表的新型网络犯罪上升为风险的主流。风险的技术含量在升级,对抗这些风险的技术也必须变革。最明显的体现是:大规模智能化技术用于防诈骗,取代了人工。

反诈骗到底是什么?首先,它是一场技术与心智的对抗赛。

在大部分人的认知里,反诈骗是安全专家与骗子之间的较量。比如,为了防止支付宝账户被盗刷,支付宝就需要建立更坚固的防护墙。

但是如今的反诈,早已不是那般简单。现在的电信网络诈骗中,骗子就是「演员」,用户就是「观众」。一旦演员抓住观众的心理,让观众入了戏,他就会深陷剧情之中,而骗子接下来的得逞就易如反掌了。

所以,现在的反诈,不止要建立防护墙将骗子拦在门外,还要想办法“唤醒”用户「心智」,将用户拉出骗子的剧情,帮助他主动识别骗局。

现在,蚂蚁集团的智能风控技术,就是在用主动交互式风控技术,让用户意识到自己被骗了。

开始,蚂蚁采用的是智能弹窗。后来,在2019年,蚂蚁推出了「叫醒热线」,AI机器人会主动致电用户,进行更有感情的语音交互。在近期,蚂蚁还开发了「安全保镖」机器人,通过图文互动进行风险揭示。

王维强介绍,在交互的过程中,系统就会采用一些AI技术,比如语言学习里的对比学习,去判断这个用户的话语中是否有前后不一致的问题,来识别他是否深度被骗。

有的用户被骗子骗得太深,已经很难制止了,对于这种用户,系统识别到后会对受骗者进行强制「冷静」。

截至目前,蚂蚁交互式风控技术已经取得了不斐的成绩。据蚂蚁发布的《2022年反诈治理半年报》显示,蚂蚁AI叫醒热线电话日均交互4.3万人次,平均语音沟通时长大于90s,AI的理解和沟通能力越来越好,用户与AI交流的意愿更强,时间也更长了。

另外,为了唤醒用户心智,反诈方自己得有快速识别诈骗团伙的能力。

在以前,很多诈骗以盗号的形式,由于是非本人操作,所以有很多可查的痕迹。但现在,当用户本人受骗,攻防的难度很大,因为这个账户不是被黑产控制,而是被用户本人操作。所以在系统视角下,就是用户自己想转一笔钱。

而且,现在的诈骗团伙作案手段越来越狡猾,诈骗过程非常隐性。

举个例子,在最后的付款阶段,骗子为了躲闪风控,有时也不会直接和被害人进行转账。而是先让他转给一个或多个正常的账户,然后再经过一系列看起来非常正常的操作之后,最终让这笔钱来到诈骗团伙的手里。

更有甚者,当骗子发现自己的账号被管控之后,还会假装好人给一些公益基金会捐款,试图借此骗过检测系统。

技术就是在这样复杂的环境里进行风险识别和风险阻止。

为了应对这些狡猾的黑灰产,各家互联网科技企业也是绞尽脑汁,毕竟风险发生的地方在这类平台居多。

为此,蚂蚁安全实验室经过数年的研发和实践打造了这套安全体系IMAGE,它是以可信AI为基础打造的一个智能风控体系。

I代表的是交互式主动风控。因为在赌博、欺诈过程中,心智非常难对抗,不能依靠单一的决策过程,因此,专家通过交互式主动风控,将这个过程拓展到和用户多次对话的交互过程中,并在过程中识别其意图,然后实现自动劝阻/唤醒。通过这项技术,对用户是否受骗的识别率大大提升。

M代表的是多方安全风控。专家将蚂蚁多年积累的先进的隐私计算能力,运用到风控领域,实现了多方参与下数据不出域,但又能够提供风控的提升。从实践中可以看出,对比单方风控,多方风控的风险识别率提升了40%。

A是博弈对抗智能。这种技术把博弈理论和机器学习结合,不仅仅是打造一个防护盾牌,同时也在磨一把刀,这把刀足够的锋利,可以自动生成脚本,生成路径,和盾相互进行攻防,从而提升盾的防御水平。应用后,有效缩短了训练AI模型以投入实战的20%训练时间。

G是全图风控。专家把图计算和风控结合起来,打造了蚂蚁风险一张图,它提高了检测效率,特别是对隐示特征的挖掘效率,提升到45%以上。目前,在线查询耗时控制在10ms以内,对黑产团伙检测准确率达到95%以上。

E是端边云协同风控。蚂蚁的思路是:风险发生在哪里,最好就在哪里进行处置。目前端边云风控的体系,覆盖了99%以上的支付宝日常交易场景,在大促的放行率也达到了90%以上。

目前,IMAGE智能安全体系已应用于支付宝及合作伙伴,保障了超10亿用户的安全。在该体系支撑下,支付宝2021年资损率低于亿分之0.98,交易风险判定0.01秒内即可完成。

这套技术有多厉害呢?今年世界人工智能大会上,基于这套安全体系开发的「智能风险感知与响应联合反诈系统」获得了大会的最高奖项「SAIL之星」奖。

风控技术的突破可以说如履薄冰,永远没有尽头。因为对手一直在那里,而且在变化。

假如你的手机落入到了骗子的手里,风险又加了一层。

2019年,一位英国的朋友发现,自己不仅能用手指解锁老婆某型号的安卓手机,甚至还能登上手机银行。

经过一番分析之后他们发现,女主当初在录入指纹的时候,是隔着手机外面套着的那层硅胶的。也就是说,女主的指纹与硅胶套纹路存在重叠,而当男主再进行指纹识别时,也会与硅胶套纹路有重叠。

于是,bug就出现了——只要是隔着这层膜,随便找一个人都能解锁这台手机……

问题一经发现,各家银行、微信以及支付宝纷纷关闭了相关机型的指纹服务。

除了指纹之外,当时在人脸识别上出现的漏洞,甚至让手机连性别也无法区分。

同样是在2019年,荷兰的消费者协会发现,在110部被测试的智能手机中,有42部只需一张机主的照片就能解锁。这些机器都来自安卓阵营。

保障智能终端里的生物识别技术本身的安全性,很迫切。

谷歌在安卓6.0时,提供了开放的指纹识别相关的API。

在2017年的安卓8.0中,除了此前使用的错误接受率(FAR)和错误拒绝率(FRR)这两种度量外,谷歌在生物识别方面又引入了欺骗接受率(SAR)和伪装接受率(IAR)。

通过分析这两个维度的信息,可以更有效地识别出用户所输入的生物识别数据是否是攻击者通过欺骗或伪装攻击进行的未认证访问。

到了2019年的安卓9.0时,谷歌再次对生物识别的认证策略进行了改进。

在手机出厂之前,各大厂商和主流实验室都是会对手机进行安全性测试的。但是存在一些问题,譬如,测试效率比较低,试用的对抗样本很可能不够全面。

通过智能化的检测,去识别技术本身是不是安全,这就为终端设备上的生物识别技术安装了一道必经的闸门。

谷歌是这样做的。2020年, 它找到了专攻智能设备生物核身技术安全性的蚂蚁安全天玑实验室,合作了联合检测实验室。

凭借着十余年的生物安全攻防经验,天玑实验室自研了一套智能设备自动化生物安全检测认证体系,包含对抗样本生成、对抗检测环境空间、对抗测试标准,依托自动化检测执行工具「机械臂」,可以在毫米级的测试精度下,为每台智能设备提供超过20万次的测试。

期间,「机械臂」会在过程中自行调整测试变量,如光线、角度、假体材质,以及攻击方式等等,完全不需要人工进行干预。

2021年4月,谷歌为这套检测系统颁发了全球第一个,也是目前唯一一个官方合作的「安卓生物识别安全检测」实验室的认证。同时,这也是国内第一个从攻击视角切入的生物识别安全性检测系统,全球70%的安卓手机出厂前都要通过这套系统的安全性检测。

这样一整套评估的实现,依托的是融合了智能安全技术、计算机视觉、机器人技术的「对抗智能」生物安全检测技术。

以对面部识别技术的安全检测为例,实验室定义了上百种不同级别的攻击方法和假体制作工艺,比如生成活化视频(基于一张平面照片,自动化生成张嘴眨眼的动态视频),融合脸(将目标的特征迁移到另一个人身上,让算法识别但人类误判),老化脸(特征不变但人类可以察觉的变化)等等检测样本。

在检测过程中,「机械臂」不仅需要智能路径规划算法和深度视觉算法去寻找和定位目标手机,还需要对机器人的高精度控制,通过引入强化学习算法及机器人技术等,可以让系统根据实时检测调整呈现距离、角度、光照强度、色温等条件,在上亿种可能快速找到成功率最高、最佳的呈现攻击组条件。

在前段时间的云栖大会上,天玑实验室直接把最新的「机械臂」搬到了现场,给大家来了一波演示。

升级之后的生物识别安全测评体系,在高精度测评结果、智能对抗缺陷挖掘、全方位攻击方式和全覆盖测评场景等多个方面,都实现了「SOTA」的效果:

▪ 全链路测评:行业首个实现「模型鲁棒性」、「防伪全面性」、「链路安全性」、「隐私合规性」的全链路测评。

▪ 对抗化检测:引入人工智能攻防对抗技术,全面挖掘被测产品的漏洞与缺陷,实现缺陷不遗漏检测。

▪ 自动化检测:通过「模型安全检测平台」、「智能机械臂」、「实验室大脑」和「无人运测机器人」的结合,提高了检测速度,并实现全链路测评的全自动化。

这些不明觉厉的技术检测,能够让手机厂商在产品发布之前,发现漏洞,从而为手机带的生物识别技术加一道安全闸门。

说了那么多,相信大家也可以看出来,网络安全的本质,就是对抗。

而一部安全发展史,其实就是对抗的进阶史。当某个安全事件为人所知时,基本上意味着对抗失败了。这一点在网络攻防上,尤为显著。

时间回到2017年,当时「WannaCry」勒索病毒席卷全球。这也是第一次,大众对网络安全有了如此广泛的认知。

此后,2018年,平昌冬奥会遭到黑客攻击;2020年,委内瑞拉国家电网遭到黑客攻击,全国大面积停电;2021年,Log4j日志框架被爆出严重漏洞,影响大量使用该日志框架的服务……各种类似的事件从未间断。

今年9月,国家计算机病毒应急处理中心连发两份「调查报告」,详细解析了「西北工业大学遭美国NSA网络攻击事件」的始末。让网络安全这个概念,再一次「出圈」。

就拿WannaCry来说吧,当你的电脑中招之后,它便会利用「EnternalBlue」(永恒之蓝)漏洞安装后门。一旦执行后门,就会释放一个名为Wana Crypt0r敲诈者病毒,从而加密用户机器上所有的文档文件。然后,黑客会非常贴心地让你的电脑弹出一个附有详细讲解的界面,还是多语言的。

没想到,这么一番兜兜转转之后,还是回到了「钱」上。

同样的,这些安全事件的本质也在兜兜转转之后,来到了「漏洞」二字上。当一个有漏洞的产品被大量部署在整个行业当中时,没有人能够独善其身。

既然问题出现在「漏洞」上,那么又该如何对抗呢?于是,各大互联网公司的安全实验室,便肩负起了提升生态安全水位的这个重任。

首先,我们可以在黑产得手之前,提前发现并处理掉这些漏洞,让他们无洞可入。而这涉及到的技术,就是「漏洞挖掘」了。

以专注安全攻防研究的蚂蚁安全天穹实验室和光年实验室举例,为了提高效率他们自研了一套自动化漏洞挖掘工具Ant-Fuzz,并在漏洞挖掘的数量和质量上,实现了全球领先的水平。

「Ant-Fuzz对当今主流的Fuzz方法体系进行了吸收融合,在易用性和接入能力上面也有很大的改善」,天穹实验室和光年实验室负责人王嘉水介绍,在安全研究员筛选出一些可能的攻击面的基础上,Ant-Fuzz会针对特定攻击面自动化生成高质量的Fuzz Driver,再通过定制化的种子以及变异算法的选取,来进行高效漏洞挖掘。

基于此,在2020年,这两个实验室仅用了三个季度的时间,就累计拿下苹果47次漏洞致谢,位列当年全球致谢数排行榜第一。在47次漏洞致谢中,包含了系统库、浏览器、内核等多个维度层面,几乎都是高危漏洞,部分漏洞评分达到了「严重」级别。

在刚刚结束的GeekPwn 2022国际极客破解大赛上,天穹实验室还凭借自己挖掘的虚拟机产品漏洞,成功挑战网安领域公认的超高技术难度项目《越狱-逃出虚拟机》项目,获评「年度极客榜冠军」,以6.04分创该赛事历年得分最高纪录。此外,该队伍还凭借另一参赛项目《特洛伊文档》,获评「年度卓越极客奖」。

然而,并不是所有的漏洞都能被提前发现,那么这时就需要想办法在尽可能短的时间内完成封堵,从而减少可能产生的损失。比如去年临近双十二时爆出的Log4j,如果采用传统的方式来进行修复,由于需要在打完安全补丁之后进行测试和灰度部署,通常需要数周的时间。

针对这一点,蚂蚁集团提出了一种全新安全防护体系「安全平行切面」。

这套体系的核心原理是,安全和应用虽然在同一个执行空间里,但同时又是平行解耦的。如此一来,安全组件便可以精细地看到业务每一个数据的流转,从而精确地发现攻击,并及时进行安全管控。

从效果来看,蚂蚁在双十二时顶着来自国际的各种攻击流量,完成了所有订单交易,没产生任何一起安全事故,或者运营事故。

由于「平行内生型」安全架构的部署并不复杂,对于那些有需要的企业来说,是可以很快地让自己具备能够快速大规模部署的精准的安全感知与干预能力。特别是,这套体系能够为老旧应用系统提供内生安全能力,实现了安全攻防与治理领域能力与效率的跨越式提升。

此外,除了事前的漏洞挖掘,和事后的应急处理以外,企业还需提升业务及技术架构的风险应对能力。

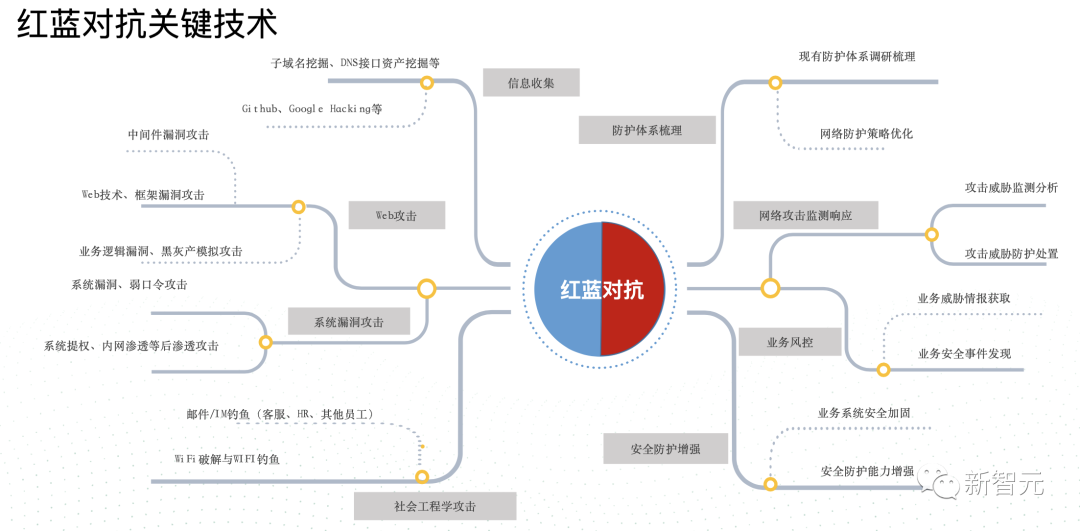

为此,蚂蚁在2016年开始,便探索并建立了「红蓝对抗」机制。

在对抗演习中,红军作为企业防守方,通过安全加固、攻击监测、应急处置等手段来保障企业安全。而蓝军作为攻击方,以发现安全漏洞,获取业务权限或数据为目标,利用各种攻击手段,绕过红军层层防护。

与传统渗透测试对比,红蓝对抗中的攻防对抗更加接近实战,能较好地体现出企业面临的真实威胁,也能更好地发现企业在安全正向建设中的不足。

举例来说,蚂蚁天穹实验室,则会用实战攻防演练,持续检验红军安全防护、威胁检测、风控策略、应急响应机制等安全建设的有效性,预判黑产攻击链路,减少系统性风险,推动攻防两端持续升级。

而百度智能云会以AI安全能力为核心,构建攻防一体的完整演练体系。火山引擎云会利用最新的APT技术,并隐蔽攻击行踪来模拟不同级别的对手。顺便提升一下「内部员工」的安全意识,防止陷入骗局。

而这不仅仅是对企业内部,对生态内的其他伙伴,这些大厂的安全实验室也会提供同样高水平的服务,通过全栈级别的大型技术攻防演练,从而达到增强团队应急处理能力和系统防护水平的目的。

总结来说,不管是全链路检测系统,还是挖掘其他厂商的漏洞,再或是联合生态里的伙伴。其实都是各方基于攻防能力内外协力,为提升整个产业的安全水位所做出的努力。